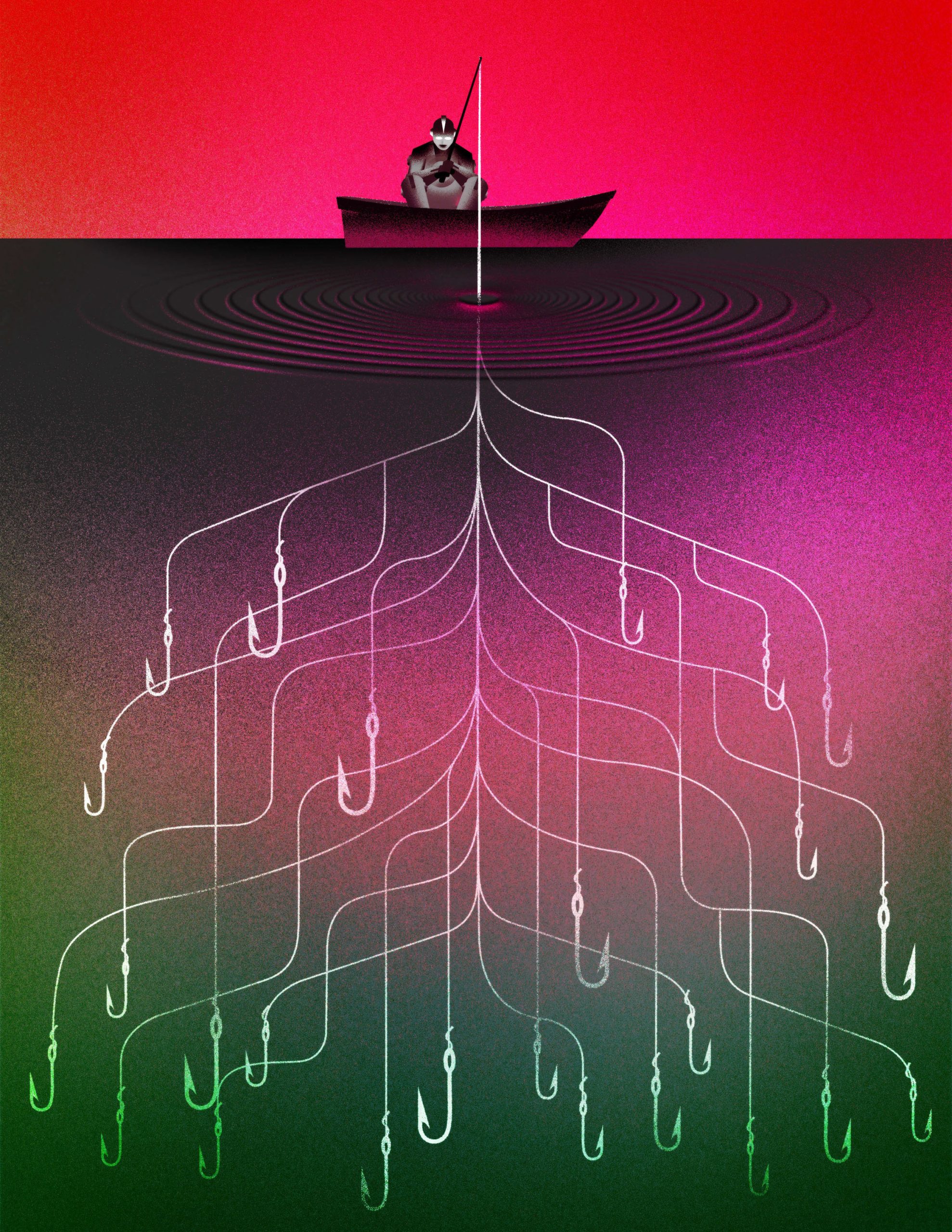

AIエージェントによる

自律型サイバー攻撃、

どこまで現実になっているか

大規模言語モデル(LLM)を全工程に組み込んだランサムウェアが発見され、AIサイバー攻撃の転換点かと注目を浴びた。だがその正体は大学の研究プロジェクトだった。一方で犯罪者たちは着実にAIを「生産性ツール」として活用し、攻撃のハードルを下げている。自律型攻撃はどこまで現実に近づいているのか。 by Rhiannon Williams2026.02.19

- この記事の3つのポイント

-

- 研究者が発見したAI活用ランサムウェア「プロンプトロック」は学術実験だったが、犯罪者のAI悪用が本格化している

- ChatGPT登場後、攻撃者はスパム生成から標的型攻撃まで生成AIを活用し、ディープフェイクによる詐欺で数千万ドル規模の被害が発生

- 完全自律型攻撃は未実現だが、AIが攻撃の障壁を下げており、従来の防御策強化と情報共有による対策が急務となっている

アントン・チェレパノフは常に、何か興味深いものに目を光らせている。そして昨年8月下旬、まさにそれを見つけた。それは、「VirusTotal(ウイルストータル)」にアップロードされたあるファイルだった。VirusTotalは、チェレパノフのようなサイバーセキュリティ研究者が提出されたファイルを分析し、ウイルスなどの悪意あるソフトウェア(いわゆるマルウェア)の可能性を調べるために利用するサイトである。そのファイルは表面上、無害そうに見えたが、チェレパノフ特注のマルウェア検出手段が反応した。その後数時間にわたり、チェレパノフと同僚のペテル・シュトリーチェクはこのサンプルの検証を続け、それがこれまで目にしたことがないものであることに気づいた。

このファイルにはランサムウェアが含まれていた。被害者のシステム上で見つけたファイルを暗号化し、攻撃者へ身代金が支払われるまで使用不能な状態にする、悪質なマルウェアの一種である。しかし、この事例が異質だったのは、大規模言語モデル(LLM)を利用していたことだった。付随的にではなく、攻撃のあらゆる段階にわたってLLMが活用されていたのだ。このランサムウェアは、ファイルがインストールされるとLLMを利用してカスタマイズされたコードをリアルタイムで生成し、迅速にコンピューター内をマッピングして機密データを特定し、コピーまたは暗号化する。そして、身代金を要求する文書を、データの内容に基づき個別にカスタマイズして作成することができた。このソフトウェアは、人間が介入しなくても自律的に動作することが可能だった。そして実行のたびに異なる挙動を見せるため、検知するのがより難しかった。

チェレパノフとシュトリーチェクはこのランサムウェアを「プロンプトロック(PromptLock)」と名付け、この発見が生成AIにおける転換点になると確信した。生成AIを悪用して極めて柔軟なマルウェア攻撃を生み出すことができる方法を示していると考えたのだ。2人はブログ記事で、AIを利用したランサムウェアの初めての事例を発見したと宣言した。この発表はすぐに、世界中のメディアの広範な注目の的となった。

しかしその脅威は、当初の印象ほど劇的なものではなかった。前述のブログ記事が公開された翌日、ニューヨーク大学の研究者チームが犯行声明を発表し、このマルウェアが実は世に放たれた本格的な攻撃ではなく、単なる研究プロジェクトであると説明したのだ。ランサムウェア攻撃の一連の活動の各段階を自動化することが可能であると証明することが目的だったという。そしてその目的は達成されたと、この研究者チームは述べた。

プロンプトロックは結局のところ学術プロジェクトだったかもしれないが、本物の悪党たちは実際に最新のAIツールを利用している。ソフトウェアエンジニアたちが人工知能を利用してコードの記述やバグのチェックをしているのと同様に、ハッカーたちもそういったツールを活用して、攻撃を指揮するのに必要な時間と労力を削減しているのだ。それによって、経験の浅い攻撃者でも何かを試してみることがより容易になっている。

サイバー攻撃が時間とともにより一般的かつ効果的なものになる可能性は、小さいどころか「極めて現実的」であると、ユニバーシティ・カレッジ・ロンドンのコンピューター科学教授、ロレンツォ・カヴァッラーロは言う。

シリコンバレーでは、AIが完全に自動化された攻撃を実行できる段階に差し掛かっていると警告する声もある。しかしほとんどのセキュリティ研究者は、この主張を大げさであると言う。「どういう訳か誰もが、AIスーパーハッカーとでも言うべきこのマルウェアのアイデアに注目しています。馬鹿げた考えです」と、セキュリティ企業エクスペルの主任脅威研究者、マーカス・ハッチンスは言う。ハッチンスは、2017年に世界規模の広がりを見せたランサムウェア攻撃「ワナクライ」を終わらせたことにより、セキュリティ界では有名である。

専門家たちが代わりに主張するのは、AIがもたらすはるかに差し迫ったリスクに、もっと細心の注意を払うべきであるということだ。AIはすでに詐欺を加速させ、その数を増加させている。犯罪者たちはますます最新のディープフェイク技術を悪用し、誰かになりすまして被害者から巨額の金銭をだまし取るようになっている。AIによって強化されたそのようなサイバー攻撃は今後さらに頻発化し、破壊的な力を増す一方であり、私たちはそれに備える必要がある。

スパム、そしてその先

2022年末にChatGPT(チャットGPT)が登場して爆発的な人気を博すと、攻撃者たちはそのほぼ直後から生成AIツールを導入し始めた。容易に想像できることかもしれないが、そういった取り組みは、スパムを大量に作り出すことから始まった。昨年発表されたマイクロソフトの報告書によれば、同社は2025年4月までの1年間で40億ドル相当規模の詐欺や不正な取引を阻止した。「その多くはAIが生成したコンテンツによって支援された可能性が高い」という。

ChatGPTのリリース前後に収集された50万件近くの悪意あるメッセージを分析したコロンビア大学、シカゴ大学、バラクーダ・ネットワークスの研究者たちの推定によれば、現在、スパムの少なくとも半数がLLMを用いて生成されているという。また、より洗練された手口でAIが活用されている事例が増えている証拠も見つかった。研究チームが調査したのは標的型のメール攻撃だ。信頼できる人物になりすまし、組織内の従業員からお金や機密情報をだまし取る手口である。調査の結果、2025年4月までにこの種の的を絞ったメール攻撃の少なくとも14%がLLMを使用して作り出されており、2024年4月の7.6%から増加していることが判明した。

そしてブームとなった生成AIは、メールだけでなく、非常に説得力のある画像、動画、音声の生成も、これまで以上に容易かつ低コストにした。生成AIの出力結果はわずか数年前よりもはるかにリアルであり、誰かの肖像や声の偽物版を生成するのに必要なデータの量は、以前よりも大幅に少なくなった。

犯罪者たちがそうしたディープフェイクを展開しているのは、人々にいたずらをしたり、単に悪ふざけをしたりするためではない。効果があり、お金を稼げるからやっているのだと、生成AIの専門家であるヘンリー・アジャーは言う。「稼げるお金が存在し、人々がだまされ続けるのであれば、犯罪者たちはやり続けるでしょう」と、アジャーは話す。2024年に報告されたある注目を浴びた事例では、1人の従業員がデジタルで生成された会社の最高財務責任者(CFO)や他の従業員とのビデオ通話を通じてだまされ、犯罪者へ2500万ドルを送金してしまった。これは氷山の一角に過ぎないだろう。技術が向上し、より幅広く採用が進むにつれ、説得力のあるディープフェイクが引き起こす問題はさらに深刻化する一方だろう。

犯罪者の手口は常に進化している。そしてAIの能力が向上する中で、そうした人々は新たな能力の助けを借りて被害者を出し抜くことができる方法を絶えず探っている。グーグルの脅威分析グループで技術責任者を務めるビリー・レナードは、「潜在的な悪意ある行為者」によるAIの利用方法の変化を注意深く監視してきた(潜在的な悪意ある行為者とは、犯罪目的でコンピューターを利用しようとしているハッカーやその他の者を指すために業界で広く使われている表現)。2024年後半、レナードのチームは、犯罪者予備軍がグーグルのGemini(ジェミニ)のようなツールを一般ユーザーと同じ方法で使っていることに気づいた。彼らはコードのデバッグや細々とした作業の自動化だけでなく、奇妙なフィッシングメールの文章作成といった仕事もAIにやらせていた。202 …

- 人気の記事ランキング

-

- EVs could be cheaper to own than gas cars in Africa by 2040 アフリカでEVがガソリン車より安くなる日——鍵は「太陽光オフグリッド」

- Promotion Emerging Technology Nite #36 Special 【3/9開催】2026年版「新規事業の発想と作り方」開催のお知らせ

- Why the Moltbook frenzy was like Pokémon 「AIの未来」と持ち上げられたMoltbookがつまらない理由

- Europe’s drone-filled vision for the future of war 欧州防衛の未来を約束する 100万機の自律ドローン、 「出口」なき軍拡の始まり

- 10 Breakthrough Technologies 2026 MITTRが選んだ 世界を変える10大技術 2026年版