AIの偏見を検証する第三者監査会社が始動

数学者キャシー・オニール博士は、アルゴリズムの公平性を検証する場を企業に提供している。

人工知能(AI)システムが高度化するにつれて、そのロジックをたどるのが難しく理解不能になり、いわゆる「ブラック・ボックス」を生み出した。こうしたアルゴリズムは、雇用やローンといった、私たちの生活の重要な部分をますます支配するようになってきている。だから、アルゴリズムの偏見と判断結果を理解するのは重要なのだ。

『Weapons of Math Destruction』(未邦訳:数学破壊の武器)の著者でもあるオニール博士は、アルゴリズムの第三者監査をする「オニール・リスク・コンサルタント&アルゴリズム監査(O’Neil Risk Consulting and Algorithmic Auditing)」を創業した。プログラムした人から訓練データまですべてを検証し、そのプロセスにおけるあらゆる偏見に警告を発する。

大多数の企業は、まだ第三者監査を利用していない(オニールのクライアントは6社だけ)。だが、企業は利用するべきだ。社会に対する最善の利益になるだけではなく、よい宣伝にもなるからだ。アルゴリズムの公正性の保証を得ることは、消費者に対し自社サービスが公平で効果的で信頼性があると証明できるのだ。

- 参照元: Wired

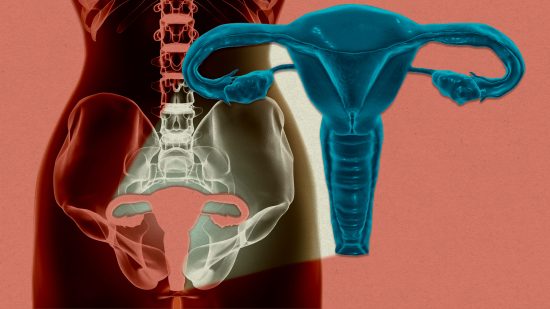

オープンAIが「年齢予測」導入、子ども保護の責任誰が負う?

オープンAIが「年齢予測」導入、子ども保護の責任誰が負う?

MITの学生は「世界を変える10大技術」から何を学んでいるか?

MITの学生は「世界を変える10大技術」から何を学んでいるか?

eムック 『日本発・世界を変えるU35イノベーター』特集号

eムック 『日本発・世界を変えるU35イノベーター』特集号

期待外れのCRISPR治療、包括的承認で普及目指す新興企業

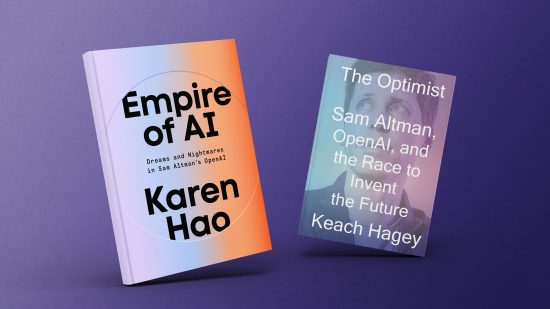

期待外れのCRISPR治療、包括的承認で普及目指す新興企業 書評:サム・アルトマンはいかにして「AI帝国」を築いたか

書評:サム・アルトマンはいかにして「AI帝国」を築いたか