人工知能(AI) 2025年12月の記事

-

-

How social media encourages the worst of AI boosterism

GPT-5が「未解決問題解いた」 恥ずかしい勘違い、なぜ? - オープンAIの研究科学者が「GPT-5が未解決数学問題10問を解いた」とXに投稿し、デミス・ハサビスが「これは恥ずかしい」と批判。実際には既存の解答をネットで見つけただけだった。ソーシャルメディアでは連日、AIに関するセンセーショナルな発表がなされているが、こうした投稿は誇大宣伝になりがちだ。 by Will Douglas Heaven2025.12.29

-

How social media encourages the worst of AI boosterism

-

- 超知能から推論、GEOまで2025年AI新語総ざらい

- 超知能、バイブコーディング、チャットボット精神病、推論、スロップ、GEO——2025年はAI関連の新語が次々と登場した。メタは数千億ドルを超知能に投じ、ディープシークの「蒸留」モデルはエヌビディア株を17%急落させた。この1年を彩った14のキーワードを、編集部が解説する。 by Rhiannon Williams2025.12.29

-

- 誇張された「新材料発見」、AI自律型ラボは材料科学の停滞を打破するか

- 「数百万もの新材料を発見」という2023年のグーグル・ディープマインドの発表は明らかに誇張されたものだった。潤沢な資金を持つスタートアップは、AIを活用したラボを作ってはるかに迅速かつ低コストで材料を発見しようとしているが、まだ大きな成果を生むにはまだ至っていない。 by David Rotman2025.12.22

-

- GPT-5ローンチ失敗、企業95%が成果出せず …転換期を迎えたAIブーム

- ChatGPT登場から3年、生成AIが転換点を迎えた。GPT-5は期待外れ、企業の95%がAI導入で価値を見出せず、元オープンAIの主任科学者も限界を認める。バブルの懸念もあるが、期待値を調整し、技術を現実的に評価する好機と捉えるべきだ。 by Will Douglas Heaven2025.12.19

-

- AIブームを作ったサム・アルトマン「誇大宣伝」10年の発言録

- サム・アルトマンの10年超の発言を追跡すると、未解決の問いにも答えが出ているかのように語り、AIを「救済」にも「破滅」にも描き分けて資金調達してきた手法が見えてくる。その誇大宣伝が現在のAIブームを作り上げた。 by James O'Donnell2025.12.17

-

-

AI might not be coming for lawyers’ jobs anytime soon

そして弁護士の仕事は残った「44%自動化」の誇大宣伝司法試験クリアも実務遠く - 生成AIの登場で狙い撃ちにされたのが、弁護士だった。2023年、GPT-4が司法試験をクリアし、「弁護士の仕事の44%が自動化される」と警告された。だが2024年の米国のロースクール就職率は93.4%で過去最高を記録し、最優秀モデルでも新ベンチマークでは37%しか正解しない。弁護士の仕事は残った。 by Michelle Kim2025.12.17

-

AI might not be coming for lawyers’ jobs anytime soon

-

-

Generative AI hype distracts us from AI’s more important breakthroughs

生成AIの陰で見過ごされる「予測AI」、命を救う静かな革命 - 生成AIの誇大宣伝が、真に有益な「予測AI」から注意をそらしている。予測AIは病変検出、地震予測、自動運転で既に活躍し、エネルギー効率も高い。ハギングフェイスの主任倫理科学者は「派手なデモではなく、静かで厳密な進歩こそがAIの未来を築く」と訴える。 by Dr Margaret Mitchell2025.12.16

-

Generative AI hype distracts us from AI’s more important breakthroughs

-

-

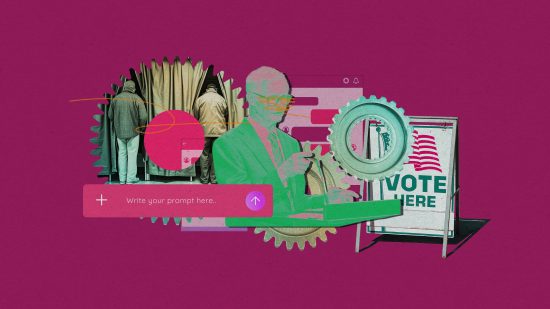

The era of AI persuasion in elections is about to begin

ディープフェイクより深刻、AIが有権者を「説得」100万ドルで票を動かす - AIによる選挙への介入としてこれまでは、フェイクニュースやフェイク動画が拡散されるリスクが指摘されてきた。だが、次の米大統領選では、人々を巧妙に「説得」して意識や意見を変えさせるAIが大規模に展開されるリスクが深刻化するだろう。 by Aneesh Pappu2025.12.11

-

The era of AI persuasion in elections is about to begin

-

-

The State of AI: A vision of the world in 2030

ChatGPT登場から3年世界は5年後、どう変わる?FT・MITTR記者が予測 - AIは人類史上最速で普及しているのか、それとも誇大宣伝なのか。ChatGPT(チャットGPT)登場から3年、フィナンシャル・タイムズとMITテクノロジーレビューの記者が5年後を予測する。 by Will Douglas Heaven2025.12.9

-

The State of AI: A vision of the world in 2030

-

-

AI chatbots can sway voters better than political advertisements

AIが有権者の意見を変えた「事実と証拠」で説得力、誤情報で世論形成のリスクも - AIチャットボットとの会話が有権者の政治的意見を変えることが、複数の最新研究で明らかになった。「事実と証拠」で語ると説得力が増すが、最も説得的なモデルほど虚偽も多く、誤情報による世論形成のリスクが民主主義を脅かす可能性がある。 by Michelle Kim2025.12.8

-

AI chatbots can sway voters better than political advertisements

-

-

OpenAI has trained its LLM to confess to bad behavior

なぜAIは嘘をつくのか? オープンAI、「告白」で内部動作を解明へ - なぜ大規模言語モデルは嘘をつき、騙すのか。オープンAIは、モデルに正直さだけを報酬とし、不正を白状させる新たな手法によって、その理由を解明しようとしている。 by Will Douglas Heaven2025.12.4

-

OpenAI has trained its LLM to confess to bad behavior

-

-

An AI model trained on prison phone calls now looks for planned crimes in those calls

米通信会社が刑務所の通話でAIを訓練、犯罪計画の検出に利用 - 米国の通信会社が、刑務所の収監者の通話を数年間にわたって記録したデータでAIモデルを訓練し、犯罪計画の検出に利用している。収監者は通話内容がAIの訓練に使われていると知らず、通話料金も負担していることから、人権団体などが懸念を示している。 by James O'Donnell2025.12.3

-

An AI model trained on prison phone calls now looks for planned crimes in those calls

-

-

The State of AI: Welcome to the economic singularity

なぜ、企業のAI導入の95%は成果ゼロなのか? テクノロジー史から読み解く - AIプロジェクトの95%は利益を生んでいない。だが1990年代のITも、成果が現れるまで時間がかかった。FT・MITTR記者が、過去の教訓から現在の停滞と将来の可能性を読み解く。 by David Rotman2025.12.2

-

The State of AI: Welcome to the economic singularity

-

-

What’s next for AlphaFold: A conversation with a Google DeepMind Nobel laureate

タンパク質予測革命から5年AlphaFold開発者、「ノーベル賞の次」を語る - 2024年、グーグル・ディープマインドのジャンパー博士は39歳という若さで、タンパク質構造予測AI「AlphaFold」開発の業績で同社のCEOと共にノーベル化学賞を受賞した。AlphaFoldがこの5年間で与えた影響や、今後の取り組みについてジャンパー博士が語った。 by Will Douglas Heaven2025.12.2

-

What’s next for AlphaFold: A conversation with a Google DeepMind Nobel laureate

- アーカイブ

-

- 2026年6月

- 2026年5月

- 2026年4月

- 2026年3月

- 2026年2月

- 2026年1月

- 2025年12月

- 2025年11月

- 2025年10月

- 2025年9月

- 2025年8月

- 2025年7月

- 2025年6月

- 2025年5月

- 2025年4月

- 2025年3月

- 2025年2月

- 2025年1月

- 2024年12月

- 2024年11月

- 2024年10月

- 2024年9月

- 2024年8月

- 2024年7月

- 2024年6月

- 2024年5月

- 2024年4月

- 2024年3月

- 2024年2月

- 2024年1月

- 2023年12月

- 2023年11月

- 2023年10月

- 2023年9月

- 2023年8月

- 2023年7月

- 2023年6月

- 2023年5月

- 2023年4月

- 2023年3月

- 2023年2月

- 2023年1月

- 2022年12月

- 2022年11月

- 2022年10月

- 2022年9月

- 2022年8月

- 2022年7月

- 2022年5月

- 2022年4月

- 2022年3月

- 2022年2月

- 2022年1月

- 2021年12月

- 2021年11月

- 2021年10月

- 2021年9月

- 2021年8月

- 2021年7月

- 2021年6月

- 2021年5月

- 2021年4月

- 2021年3月

- 2021年2月

- 2021年1月

- 2020年12月

- 2020年11月

- 2020年10月

- 2020年9月

- 2020年8月

- 2020年7月

- 2020年6月

- 2020年5月

- 2020年4月

- 2020年3月

- 2020年2月

- 2020年1月

- 2019年12月

- 2019年11月

- 2019年10月

- 2019年9月

- 2019年8月

- 2019年7月

- 2019年6月

- 2019年5月

- 2018年11月

- 2018年10月

- 2017年10月