「世界の消費電力量の10%がAIになる日」はやってくるか?

人工知能(AI)の需要の高まりに伴い、機械学習アルゴリズムの訓練や実行などのAI関連ワークロードが消費する電力が急増していることに警鐘を鳴らす人々が増えている。しかし、一方では、AIの消費電力を削減するための取り組みもいくつか始まっており、今後、事態がどう転ぶかを予測するのは難しい。 by Martin Giles2019.08.01

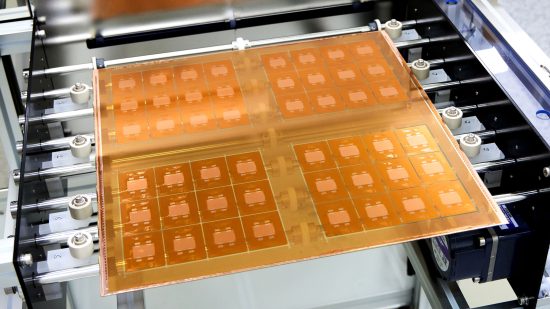

7月上旬にサンフランシスコで開催されたカンファレンス「AIデザイン・フォーラム(AI Design Forum)」で、半導体産業の大手サプライヤーであるアプライド・マテリアルズ(Applied Materials)のゲイリー・ディッカーソンCEO(最高経営責任者)が大胆な予測をして注目を集めた。 ディッカーソンCEOは、材料やチップの製造、設計に大きなイノベーションがなければ、2025年までにはデータセンターの人工知能(AI)ワークロードが世界の電力使用量の10分の1を占めるようになる可能性があると警告したのだ。

現在、世界中の何百万というデータセンターが、世界全体に占める電力使用量の割合は2%弱であり、しかもその統計には、センターが持つ膨大な数のサーバーで処理されるあらゆる種類のワークロードが含まれている。アプライド・マテリアルズでは、現在AIを実行しているサーバーが世界の電力消費量に占める割合はわずか0.1%と見積もっている。

警戒の声を上げるテック企業幹部はほかにもいる。ファーウェイ(Huawei)のアンダース・アンドレー上級エキスパートは、データセンターが2025年までに地球全体の電力の10分の1を消費する可能性があると考えている。ただし、アンドレーの予想値にはすべてのワークロードが含まれており、AIだけについて言っているわけではない。

一方、非営利団体のロッキー・マウンテン研究所(Rocky Mountain Institute)で上級科学者の特別顧問を務めるジョナサン・クーメイ博士の見方は楽天的だ。クーメイ博士の予測では、AI関連活動の急増にもかかわらず、データセンターのエネルギー消費は今後数年間は比較的横ばいに留まるという。

こうした大幅に異なる予測こそが、AIが大規模コンピューティングの将来にもたらす影響やエネルギー需要に最終的にもたらす影響が、いかに不確定なものであるかを浮き彫りにしている。

より大きな全体像

AIが電力を大量に消費することは確かだ。深層学習モデルなどの訓練や実行には膨大な量のデータ処理が伴い、メモリやプロセッサに負担をかける。非営利のAI研究団体「オープンAI …

- 人気の記事ランキング

-

- A new US phone network for Christians aims to block porn and gender-related content ポルノもLGBTも遮断、キリスト教徒向けMVNOが米国で登場

- The problem with thinking you’re part Neanderthal あなたの中にいる 「ネアンデルタール人」は 本当に存在するのか?

- Musk v. Altman week 1: Elon Musk says he was duped, warns AI could kill us all, and admits that xAI distills OpenAI’s models 「オープンAIを蒸留した」マスク対アルトマン第1週、法廷がざわめく

- Will fusion power get cheap? Don’t count on it. 核融合は本当に安くなるのか? 楽観論に「待った」をかける新研究