米ユーチューバー炎上で露呈した、有害コンテンツ対策の限界

ユーチューバーのローガン・ポールが、12月31日にユーチューブ(YouTube)にある映像をアップロードした。自殺の名所として知られる富士山麓の樹海で、首つり自殺した人の遺体を前にジョークを連発している様子を映した映像である。

知らない人のために書いておくと、彼には1500万人のフォロワーがいる。そしてこの映像は、ポールが削除するまでに600万ビュー以上を集めた。

問題なのは、ポールの映像がユーチューブの監視ソフトウェアや人力によるチェックでは検知されなかったことだ。ポールの映像は、最高水準の人工知能(AI)システムの目をかいくぐった、決して拡散してはいけないコンテンツの典型例となってしまった。

マイクロソフト・リサーチのタールトン・ギレスピー主任研究員はバズフィードに対して、「実に不愉快なのは、自殺者の遺体を公に見せて冒とくしたことです」と語っている。「自動化ツールでは判断が難しい文脈であり、微妙な倫理的な問題なのです」。

この事件は、フェイスブックやユーチューブがAIを使って有害コンテンツを取り除こうとしても、コンテンツのモデレーションは小手先のソフトウェアでは解決されないことを示している。

- 参照元: Buzzfeed、Tech Crunch

オープンAIが「年齢予測」導入、子ども保護の責任誰が負う?

オープンAIが「年齢予測」導入、子ども保護の責任誰が負う?

MITの学生は「世界を変える10大技術」から何を学んでいるか?

MITの学生は「世界を変える10大技術」から何を学んでいるか?

eムック 『日本発・世界を変えるU35イノベーター』特集号

eムック 『日本発・世界を変えるU35イノベーター』特集号

期待外れのCRISPR治療、包括的承認で普及目指す新興企業

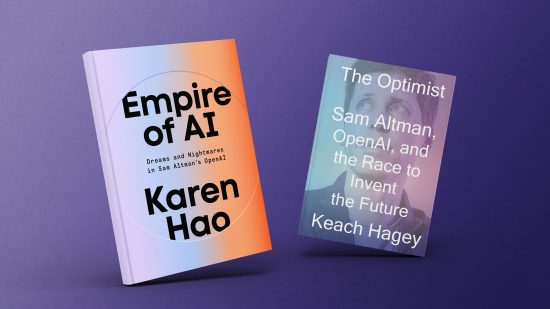

期待外れのCRISPR治療、包括的承認で普及目指す新興企業 書評:サム・アルトマンはいかにして「AI帝国」を築いたか

書評:サム・アルトマンはいかにして「AI帝国」を築いたか