表情そのままに匿名化、ディープフェイクで内部告発者を守る新手法

匿名希望の人の本来の表情を維持しながら「新しい顔」を生成することでプライバシーを保護する、新しい人工知能(AI)の手法が開発された。

ノルウェー科学技術大学の研究者らはこのほど、ディープフェイクの基盤技術である敵対的生成ネットワーク(GAN)を使用して、写真や動画でユーザーを匿名化する新しい手法を開発した。

仕組みはこうだ。このアルゴリズムは、最初にユーザーの目、耳、肩、鼻の位置を見付けて、その人の表情に関する情報を抽出する。 次に、150万件の顔画像データベースで訓練されたGANを使って、同じ表情をしているまったく新しい別の顔を作成する。最後に、背景を保持しながら、新たに作成した顔を元の写真に重ね合わせる。

この手法はまだまだ実験段階にある。多くの種類の写真や顔に適用できるものの、写真によっては顔が部分的に遮られたり、特定の角度で回転したりといった不具合もある。さらに動画の場合には不具合がたくさんあるようだ。

AIを使ってユーザーの顔を匿名化する手法はこれが初めてではない。今年2月、ニューヨーク州立大学オールバニ校の研究グループが発表した論文では、深層学習を使って被験者の表情の主な要素を他の人の顔に「移植」している。この方法では自分の顔を、他人の表情を乗せる「キャンバス」として使われることに同意した「顔のドナー」が必要だ。

顔の匿名化は、写真や映像において内部告発者などの身元を保護するために使用される。だが、ぼかしやピクセル化などの従来の手法では、不完全な場合があったり(個人が特定されるリスクがある)、もしくは本来の表情が完全に無くなってしまったりする問題がある。だがGANはユーザーの元の顔をまったく使わないため、前者の問題に関するリスクを排除できる。また、顔の表情を高解像度で再作成できるため、後者の問題に対する解決策も提供する。

GANは常に悪者ではない。GANは、極めて説得力のあるデマを作る障壁を低くしているという汚名を着せられているが、今回の手法は新しい提供価値を見出している。今回の研究自体は視覚メディアに限定されているが、適用範囲を拡張し、音声を匿名化する応用例についても言及している。

オープンAIが「年齢予測」導入、子ども保護の責任誰が負う?

オープンAIが「年齢予測」導入、子ども保護の責任誰が負う?

特別編集版『ポスト都市時代の社会デザイン 社会実装都市 ひろしま』発行のお知らせ

特別編集版『ポスト都市時代の社会デザイン 社会実装都市 ひろしま』発行のお知らせ

eムック 『新・陰謀論の時代 社会を蝕む「信念」の正体』特集号

eムック 『新・陰謀論の時代 社会を蝕む「信念」の正体』特集号 期待外れのCRISPR治療、包括的承認で普及目指す新興企業

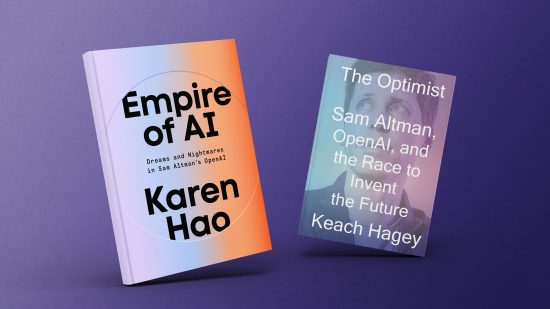

期待外れのCRISPR治療、包括的承認で普及目指す新興企業 書評:サム・アルトマンはいかにして「AI帝国」を築いたか

書評:サム・アルトマンはいかにして「AI帝国」を築いたか