「人間と同等の音声認識を実現」

マイクロソフトの論文を読んでみた

マイクロソフトは少しだけズルをした可能性はある。しかし、自然言語の音声認識で人間は機械に負けるのだ。 by Emerging Technology from the arXiv2016.10.25

機械より人間が勝る技能が、少しずつ機械側に移っている。初めはチェス、次は「ジェパディ!」(IBMの人工知能がチャンピオンを負かしたアメリカのクイズ番組)。囲碁、物体認識、顔認識、ビデオゲーム全般まで。人間はもう時代遅れだと思えても仕方がない。

しかし、音声認識ソフトウェアを実際に使ってみると、人間であることに自信が戻ってくる。確かに実用段階にはあるし、改善し続けているとはいえ、音声認識システムは完璧からは程遠い。アイスクリームを注文しているのか「私は叫ぶ(アイ・スクリーム)」と言っているのか? 機械相手の会話なら、機械はどちらかわからず計算しているはずだ。

日常会話の音声認識は、機械がいまだに苦戦する分野だ。人間の言語はまだまだ人間のものなのだ。

その見方を、変えざるを得ないかもしれない。それもいますぐ。10月24日、ワシントン州レッドモンドにあるマイクロソフト・リサーチのジェフ・ツヴァイク研究主幹のチームが日常会話の音声認識研究について根本から見直したところ、研究チームの機械学習アルゴリズムは現在、日常会話の言語認識において、初めて人間を上回ったという。

音声認識の研究には長い歴史がある。1950年代、初期のコンピューターはひとりの人間が明瞭に発音する単語を10個まで認識できた。1980年代、研究者は1000単語の語彙があり、簡単な発語を文字に起こせる機械を構築した。1990年代、機械はウォール・ストリート・ジャーナル紙を人が読み上げた録音やニュース放送の解説を認識するまでに進歩した。

音声認識は、段階的に難しい課題に挑み、乗り越えてきたわけだ。しかし、これまで達成してきたことは、さまざまな制約条件があり、日常会話より簡単だ。ウォール・ストリート・ジャーナル紙の語彙はビジネスと経済の分野に限られており、文章は上手に組み立てられ、文法的に正しい。しかし、会話は必ずしもそうとは限らない。ニュース放送の音声は形式ばってはいないが、それでも体系だっており、はっきりと発音されている。機械は、ここまでならすでに全て制覇した。

しかし最も難しい課題である日常会話の文字起こしは、機械からの猛攻撃を断固として耐え抜いてきた。

日常会話は語彙の大きさや、人が話す際に出す言葉以外の音のせいで、従来のどの課題よりも難しい。人間は会話の話者をスムーズに交替するため、言語学者が「相づち表現」と呼ぶ、さまざまな音でコミュニケーションする。

たとえば、「うん、うん」という音は話し手を認め、その話し手が話を継続するのを促すために使われる。しかし「んー」いう音は話し手のためらいを表し、話し手には別の言い分があることを示しており、まだ情報が発信されると警告している。会話をスムーズに進める暗黙の了解事項として、「んー」は「うん、うん」の逆の役割を果たしているわけだ。

人間はこうした音の構文解析や役割の理解に苦労することはほとんどない。しかし機械は相づち表現が苦手だ。

2000年、米国国立標準技術研究所(NIST)は、研究者が日常会話の音声認識に取り組めるように、電話での日常会話の録音をデータセットとして公開した。録音の一部は、特定の話題に関する個人間の会話で、残りは不特定の話題に関する友人または家族間の会話だ。

データセットの大半は、機械学習アルゴリズムが会話を認識する訓練に用い、残りのデータは、機械の文字起こしの性能を試験するために使う。

アルゴリズムの性能は機械が間違えた単語の数で測定され、究極の目標は人間よりも作業の精度を上げることだ。

さて、人間はどれだけ上手に文字起こしができるのか? 一般的な見解では、人間の文字起こしの誤り率は約4%だ。別の言い方をすれば、人間は100単語ごとに4単語、文字起こしを間違える。以前の機械はこの水準に全く及びもしなかった。

現在、マイクロソフトは「但し書き」付きではあるが、機械が人間の能力と並んだという。マイクロソフトの研究者は、まず、人間の文字起こし作業の能力を再評価した。研究者は、NISTのデータセットにある電話録音をプロの文字起こしサービスに送り、誤り率を測定し、人間の誤り率を再測定したのだ。

驚いたことに、プロの文字起こしサービスの誤り率は、指定された話題に関する個人間の会話では5.9%、話題を指定しない友人または家族間の会話では11.3%だった。人間の誤り率は言われていたよりもずっと高いのだ。

次に、研究チームは、会話の異なる側面を処理する、多くの層から成る畳み込みニューラルネットワークに基づき、自身の深層学習システムを最適化した。その上で、研究チームは訓練用データセットを使って機械が日常会話を理解するように訓練し、試験データセットに取りかからせた。

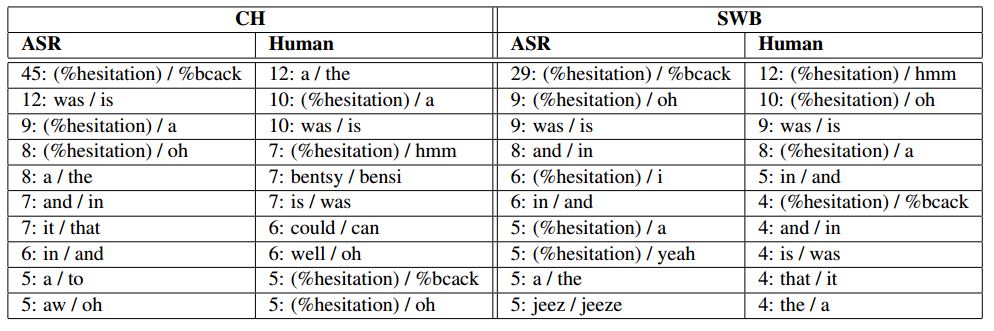

結果として、総合的に、マイクロソフトの音声認識システムの誤り率は人間と同等だが、間違いの種類は相当異なる。

マイクロソフトの機械がする最もありふれた間違いは、相づち表現の音「んー」と「うん、うん」を混同してしまうことだ。一方、人間はこの間違いをほとんどしない代わりに「a」と「the」あるいは「んー」と「a」を混同してしまう傾向がある。

原理的には、機械が相づち表現の音を認識するように学習できない理由はない。研究チームは、機械が相づち表現が苦手なのは、相づち表現の音が訓練用データセットの中でラベル付けされている方法のせいだと考えている。「ここで見られる自動システムの比較的低い性能は、単に訓練用データの注釈に起因する混乱が原因である可能性があります」と研究チームはいう。

しかし総合的には、指定された話題に関する個人間の会話について、機械の誤り率は人間の誤り率5.9%と並んだが、話題を指定しない友人または家族間の会話の誤り率は11.1%と、人間を上回った。

「初めて自動認識の性能が、文字起こしで人間の能力と並んだことを報告します」

これは興味深い研究だ。マイクロソフトはこの勝利を記録するために、機械に有利なようにルールを調整した可能性があるが、ハッキリわかったことがある。機械が音声認識で人間を上回っているのだ。今後、人間と機械の接し方に重大な変化があるだろう。特に、アイスクリームを注文する時は。

参照:arxiv.org/abs/1610.05256:日常会話の音声認識で人間と対等に立つことを達成

- 人気の記事ランキング

-

- Is fake grass a bad idea? The AstroTurf wars are far from over. 「一番ましな悪い選択肢」 人工芝の安全性をめぐる 論争はまだ終わらない

- Digging for clues about the North Pole’s past 12万年前は無氷だった?海底22メートルの泥で掘り起こす北極点の謎

- Is carbon removal in trouble? 炭素除去業界に激震、最大顧客のマイクロソフトが購入を一時停止

- NASA is building the first nuclear reactor-powered interplanetary spacecraft. How will it work? 初の原子力推進で火星へ、 NASA「強気すぎる」計画 SR-1はどう動くのか?

- エマージングテクノロジー フロム アーカイブ [Emerging Technology from the arXiv]米国版 寄稿者

- Emerging Technology from the arXivは、最新の研究成果とPhysics arXivプリプリントサーバーに掲載されるテクノロジーを取り上げるコーネル大学図書館のサービスです。Physics arXiv Blogの一部として提供されています。 メールアドレス:KentuckyFC@arxivblog.com RSSフィード:Physics arXiv Blog RSS Feed