新型コロナウイルス感染症(COVID-19)のパンデミック発生以来、人材の雇用に人工知能(AI)を導入する企業が増えている。特に一般的なものは、顔スキャニング・アルゴリズムやゲーム、質問などで応募者を評価し、面接候補者を絞り込むシステムだ。

活動家や学者らは、このような選考ツールは差別を固定化する可能性があると警告する。一方で選考ツールを開発する企業は、アルゴリズムを活用した雇用は人間の持つ偏見(バイアス)の修正に有効だと主張している。アルゴリズムはテストを実施して改良できるが、人間の偏見は思考と同じように修正が難しいというわけだ。コーネル大学の研究チームは2019年12月に発表した論文で、アルゴリズムによる選考ツールを開発している企業を評価し、企業側の主張と実態について分析している。コーネル大学のチームによる評価では英語のWebサイトを持つ18社の企業の過半数が、人間による選考に代わり、より公平な雇用が実現できると売り込んでいる。それらの企業は、アルゴリズムを活用した雇用への懸念が高まっていることを理解しており、自社のツールの長所を売り込んで、より多くの顧客を集めようとしているようだ。

だが、アルゴリズムを活用した雇用で懸念されているのは差別だけではない。一部の学者は、企業が偏見の問題に焦点を当てることで、労働者の権利問題など他にも抱えている問題から目をそらそうとすることを懸念している。こうした企業の1つが発表した新たなプレプリント(査読前論文)は、重要な警告を発している。マイクロソフト・リサーチで主任研究員を務めるコーネル大学のソロン・バロカス助教授は、アルゴリズムの公平性と説明責任について研究している。バロカス助教授は、「人々の注目が偏見や差別に集まっていますが、他にも数多くの問題があるという事実を忘れてはいけません」と述べる。

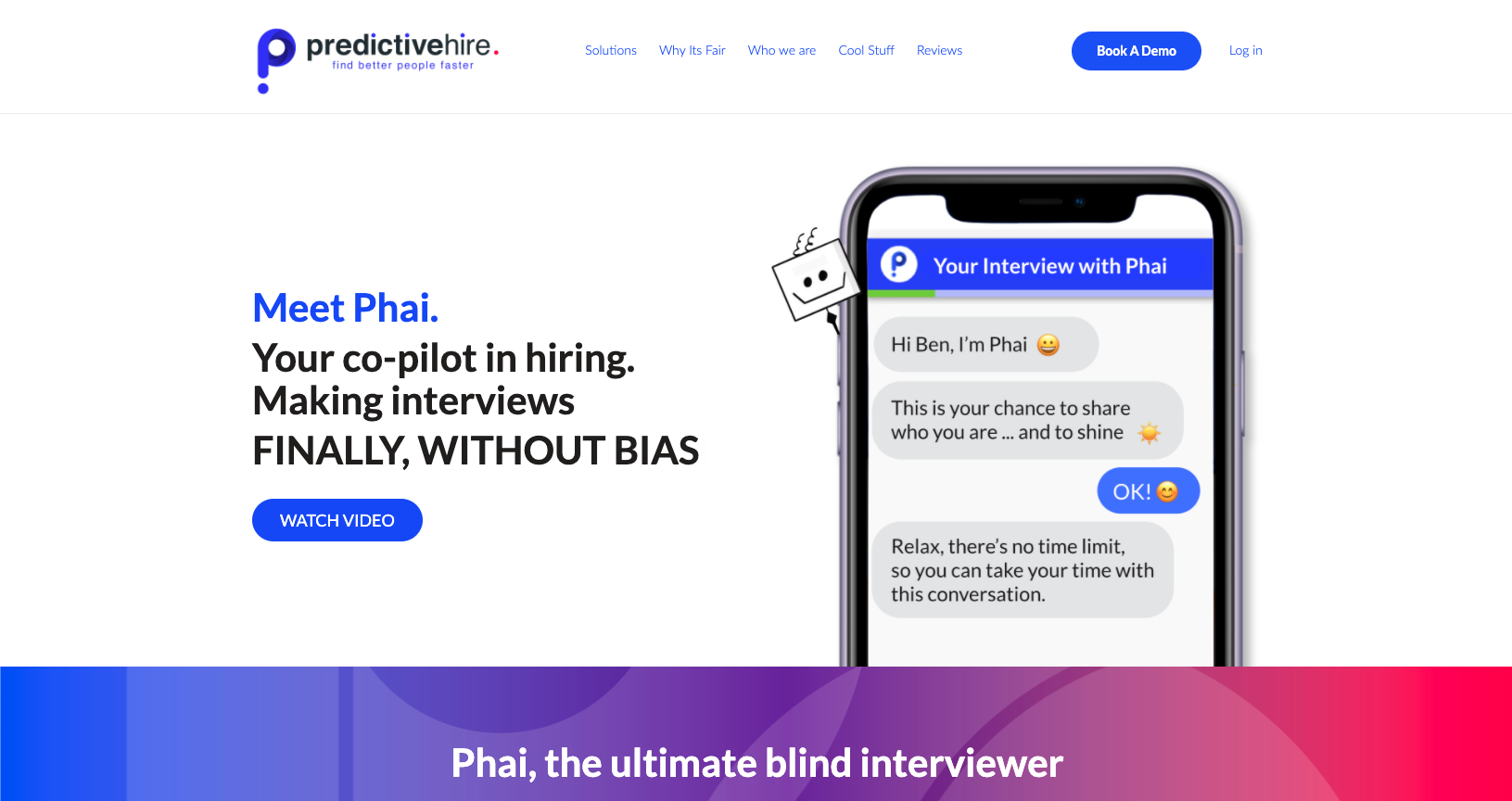

問題となっている企業は、2013年10月にオーストラリアを拠点に設立されたプレディクティブハイア(PredictiveHire)だ。プレディクティブハイアは、応募者に対してさまざまな自由回答形式の質問を投げかけるチャットボットを提供している。応募者の回答を分析し、「意欲」「自発性」「回復力(レジリエンス)」といった、仕事に関わるパーソナリティを評価する。プレディクティブハイアのバーバラ・ハイマン最高経営責任者(CEO)によると、同社の顧客は小売、営業、コールセンター、保健医療など、多人数の求人をかけている分野の雇用主だという。コーネル大学の研究によって明らかにされたが、プレディクティブハイアはより公平な雇用の実現を売り …

- 人気の記事ランキング

-

- A new US phone network for Christians aims to block porn and gender-related content ポルノもLGBTも遮断、キリスト教徒向けMVNOが米国で登場

- Musk v. Altman week 1: Elon Musk says he was duped, warns AI could kill us all, and admits that xAI distills OpenAI’s models 「オープンAIを蒸留した」マスク対アルトマン第1週、法廷がざわめく

- Will fusion power get cheap? Don’t count on it. 核融合は本当に安くなるのか? 楽観論に「待った」をかける新研究

- The problem with thinking you’re part Neanderthal あなたの中にいる 「ネアンデルタール人」は 本当に存在するのか?