「生成」ブームの2022年、AIは来年どこに向かうのか?

2022年は画像生成AIに代表される「生成AI」が一大ブームとなった。次に話題になりそうなAIは何だろうか? by Melissa Heikkilä2022.12.09

この記事は米国版ニュースレターを一部再編集したものです。

2022年は、生成AIの分野でブレークスルーが相次いだ。例えば、数個の単語から動画を生成する人工知能(AI)や、曲の断片からそれに続くメロディを生成するモデルなどだ。

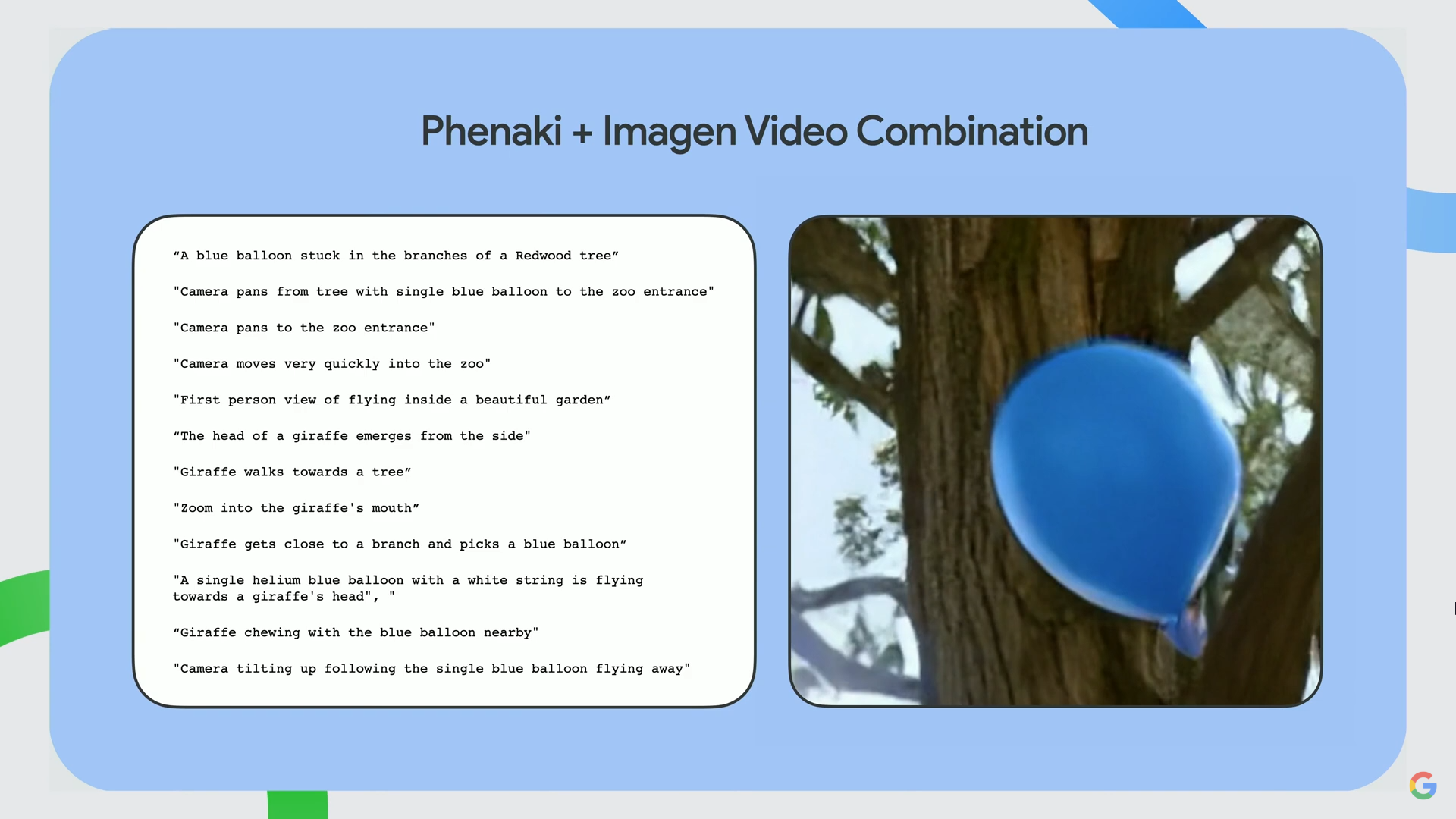

グーグルは先日、マンハッタンのハドソン川沿いにある洒落た真新しいオフィスで、AIイベントを開催した。私はその騒ぎにつられて立ち寄ってみた。グーグルもまた、現在のトレンドの合わせて、生成AIの成果を次々と発表している。その1つに、テキストから動画を生成する同社の2つのAIモデル、フェナキ(Phenaki)とイマジェン(Imagen)を組み合わせたシステムがある。フェナキが、脚本のように見える一連のテキスト・プロンプトが付いた動画をシステムに生成させ、イマジェンが動画の解像度を上げるというものだ。

しかし、これらのモデルが広く普及するまで、まだ長い道のりがある。訓練データの性質から、暴力的、性差別的、人種差別的、著作権侵害的なコンテンツが生成されてしまうなど、まだ大きな問題を抱えている(訓練データのほとんどは、インターネットでかき集めたものだ)。あるグーグルの研究者は、これらのモデルはまだ初期段階にあり、実際の製品で使用するには、まだ多くの「ピースが揃う」必要があると話してくれた。研究としてはすばらしいが、グーグルがそのテクノロジーをどのように実用化できるかは不明だ。

もっと早く現実世界で影響を持つようになる可能性があるのは、400以上の言語で訓練された「ユニバーサル・スピーチ・モデル」を開発するグーグルの新プロジェクトだと、グーグルのAI研究担当副社長のズビン・ガラマニはイベントで述べた。グーグルは詳細を明らかにしなかったが、数カ月以内に論文を発表するという。

成功すれば、これは大規模言語モデル(LLM:Large Language Models)の能力の大きな飛躍を意味する。AIスタートアップ企業のハギング・フェイスのLLMであるBLOOM(ブルーム)は46の言語で訓練され、メタは数百の言語をリアルタイムで翻訳できるAIモデルの開発に取り組んでいる。モデルがより多くの言語から学習データを受けられれば、グーグルはもっと多くの人々にサービスを提供できるようになる。何百もの言語を1つのAIモデルに組み込むことで、グーグルはユーチューブでより高精度の翻訳や字幕を提供したり、検索エンジンを改良してもっと多くの言語で検索結果を出したりできるようになる。

米国東海岸を訪れている間、私は世界最大級のAI研究所のいくつかでトップに会った。来年話題になると考えるAI技術は何か? 以下で紹介しよう。

ダグラス・エック(グーグル・リサーチ主席科学者、グーグル・ブレイン研究部長)

次のブレークスルーは、複数の感覚を備えたマルチモーダルAIモデルで起こるだろうとエックは語ってくれた。例えば、コンピューターの画像や音声を利用して物事を解釈する能力などだ。次の大きな課題は、周囲の環境を感知するAIモデルに言語モデルを組み込む方法を考えることである。これが実現すれば、例えばロボットが視覚や言語による手がかりや音声コマンドによって周囲の環境を理解することを助けることができる。

ヤン・ルカン(メタ 最高AI科学者)

ルカンは、生成AIはますます進化するという。「私たちは、AIから何を引き出すかを指定するもっとよい方法を開発できると思います」。現在、AIモデルはプロンプトに反応するが、「今のところ、テキスト生成システムがやろうとすることを制御するのは非常に難しいのです」と付け加えた。将来は、「アーキテクチャーを少し変えて、もっと意図的なプランができるようになるはず」と期待している。

ライア・ハドセル(ディープマインド研究部長)

ハドセルも、マルチモーダル(音声、言語、視覚など複数の種類のデータを扱う)生成AIシステムに期待を寄せる。試行錯誤を通してAIモデルに自己学習させる強化学習を加えることで、「探索し、自律性を持ち、周囲の環境とやり取りする能力」を持つAIモデルが実現するかもしれないという。

◆

AI労働者たちにとって、ツイッターの大量解雇が意味するもの

先日レポートしたように、イーロン・マスクによる買収以来、ツイッターは100万人以上のユーザーを失った可能性がある。310万以上のアカウントと、その稼働状況を毎日分析してツイッター上の不正行為を追跡するボット・センチネル(Bot Sentinel)は、およそ87万7000件のアカウントが削除され、さらに49万7000件が10月27日から11月1日の間に停止されたと考えている。これは通常の数の2倍以上だ。

何が起こっているか明白だ。ユーザーは、ツイッターが楽しめない場所になるだろうと考えているのだ。理由の1つとしては、ツイッターのAI倫理チームの全員をはじめ、プラットフォームの安全性を確保するチームで働く人たちをマスクCEOが解雇したことがある。これには、マスクCEOも後悔することになるかもしれない。ツイッターはすでに、機械学習に関連する13のポジションでエンジニアやプロダクトマネージャーを再雇用している。プライバシー、プラットフォームの不正操作、ガバナンス、テロや暴力的な過激主義、組織的攻撃からオンラインユーザーを保護する役割もそこには含まれている。

憂慮すべきこともある。応用AI倫理の先駆者であるルマン・チョードリーが率いてきたAI倫理チームは、ツイッターのコンテンツ・モデレーション・アルゴリズムが有害な副作用を起こさないように抑制していた。彼らはアルゴリズムに偏りがないか確認してもらうためにソースコードを外部に公開するなど、素晴らしい仕事をしてきた。しかし、AI倫理担当者たちの仕事は一般に知られておらず、むしろ反発される事態に直面している。この問題は彼らを疲弊させかねない。ツイッターに残った人々は、以前よりはるかに少ないリソースで、同じ問題を解決しなければならないプレッシャーに直面する。厄介なことになるはずだ。世界経済が不況の淵に立たされている今、マスクCEOのようなトップがAI倫理部門を真っ先に切り捨てて構わないと考えるのは、実に憂慮すべき兆候だ。AI倫理は、AIシステムの公正と安全を保証する部門だ。

AI関連のその他のニュース

誰でもAI画像生成のバイアスを発見できるツール

ハギング・フェイス(Hugging Face)の研究者サーシャ・ルッチョーニのツールを使えば、テキストから画像を生成するAI「ステーブル・ディフュージョン」が一定の単語の組み合わせに対し、どのようにバイアスのかかった結果を生成するかを誰でもテストできる。(ヴァイス)

ワシントンD.C.を密かに(そして、たぶんあなたの町も)動かしているアルゴリズム

電子プライバシー情報センター(Electronic Privacy Information Center)の最近の報告によると、ワシントンD.C.では20の機関でアルゴリズムを使用しており、その3分の1以上が警察や刑事司法に関連していることが判明した。(ワイアード)

タンパク質の構造を計算するメタのAI

AI技術を生物学に応用するディープマインドの先例に倣って、メタは、解明されていない数億種類のタンパク質の構造を明らかにするAIを発表した。これまでの3倍にあたる、6億種類の構造はを明らかにしたという。(メタ)

- 人気の記事ランキング

-

- The balcony solar boom is coming to the US 安全性は大丈夫? 米国で「バルコニー発電」がブーム

- Musk v. Altman week 1: Elon Musk says he was duped, warns AI could kill us all, and admits that xAI distills OpenAI’s models 「オープンAIを蒸留した」マスク対アルトマン第1週、法廷がざわめく

- The era of AI malaise AI閉塞感の時代、私たちはまだ何も分かっていない

- Inexpensive seafloor-hopping submersibles could stoke deep-sea science—and mining 95%が未解明の「深海」へ 低コストの自律ロボットが 地球資源の地図を描き始めた

- メリッサ・ヘイッキラ [Melissa Heikkilä]米国版 AI担当上級記者

- MITテクノロジーレビューの上級記者として、人工知能とそれがどのように社会を変えていくかを取材している。MITテクノロジーレビュー入社以前は『ポリティコ(POLITICO)』でAI政策や政治関連の記事を執筆していた。英エコノミスト誌での勤務、ニュースキャスターとしての経験も持つ。2020年にフォーブス誌の「30 Under 30」(欧州メディア部門)に選出された。