医療アルゴリズムが人種差別、訓練データの偏りを反映

過去のデータを使って機械学習アルゴリズムを訓練し、予測するリスクを指摘する新しい研究だ。

カリフォルニア大学バークレー校の研究グループがサイエンス誌に発表した論文によると、特別な医療サービスの提供が必要な患者を予測するために米国の多くの医療機関が使っているアルゴリズムにおいて、白人患者が黒人患者よりも優先されていたことが明らかになった。事実上、腎臓疾患や糖尿病などを患う白人が黒人よりも優先的に特別な医療サービスを受けられるようになっていたのだ。

研究グループは、ある大規模な大学病院(名前は伏せられている)の約5万件のデータを解析した。解析後、白人患者は実際に同じ病状である黒人患者よりも高いリスク・スコアが与えられていたため、より専門的な看護や治療の予約など、特別な医療サービスで選択される可能性が高いことが明らかになった。また研究グループは、このバイアスにより、特別な医療サービスを受ける黒人患者の割合が本来よりも半分以上少なくなっていたと算出している。

研究グループは使用されているソフトウェア名に言及していないが、ワシントンポスト紙は米国の大手保険会社ユナイテッドヘルス(UnitedHealth)傘下の「オプタム(Optum)」のソフトウェアだとしている。ユナイテッドヘルスは、「7000万人以上の命を管理する」ためにオプタムのソフトウェアが使われているとしている。また研究グループは、同じ問題が他の医療意思決定ソフトウェアにも存在する可能性が高いと指摘している。

ソフトウェアのアルゴリズム自体が、人種によって意思決定するようにプログラムされているわけではない。人種によって意思決定が左右されれば、間違いなく違法になってしまう。オプタムのソフトウェアは患者の病歴を元に医療費を予測しており、この医療費に人種の違いが反映されていた。社会経済的およびその他の理由により、黒人患者は同じ病歴を持つ白人患者よりも、支払う医療費が少なくなっていたのだ。その結果、このアルゴリズムは白人患者と比べて明らかに病状の重い黒人患者にも、まったく同じスコアを与えていたのだ。

研究グループはオプタムと協力してすでに問題を修正している。患者の将来の医療コストと、今後1年間で慢性疾患が再発する回数の両方を予測するバージョンを作成し、人種間の格差を80%以上削減できたという。したがって、アルゴリズムのバイアスは修正できる。ただ、あなたがそのバイアスに気がつければの話だが。

オープンAIが「年齢予測」導入、子ども保護の責任誰が負う?

オープンAIが「年齢予測」導入、子ども保護の責任誰が負う?

MITの学生は「世界を変える10大技術」から何を学んでいるか?

MITの学生は「世界を変える10大技術」から何を学んでいるか?

eムック 『世界を変える10大技術[2026年版]』特集号

eムック 『世界を変える10大技術[2026年版]』特集号

期待外れのCRISPR治療、包括的承認で普及目指す新興企業

期待外れのCRISPR治療、包括的承認で普及目指す新興企業 書評:サム・アルトマンはいかにして「AI帝国」を築いたか

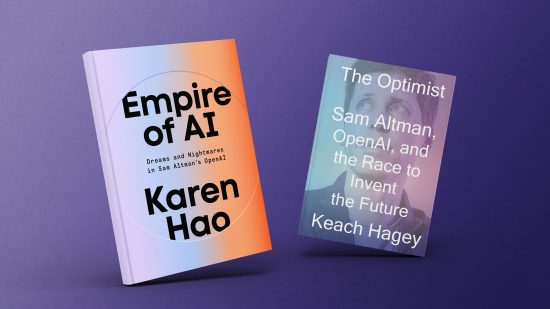

書評:サム・アルトマンはいかにして「AI帝国」を築いたか