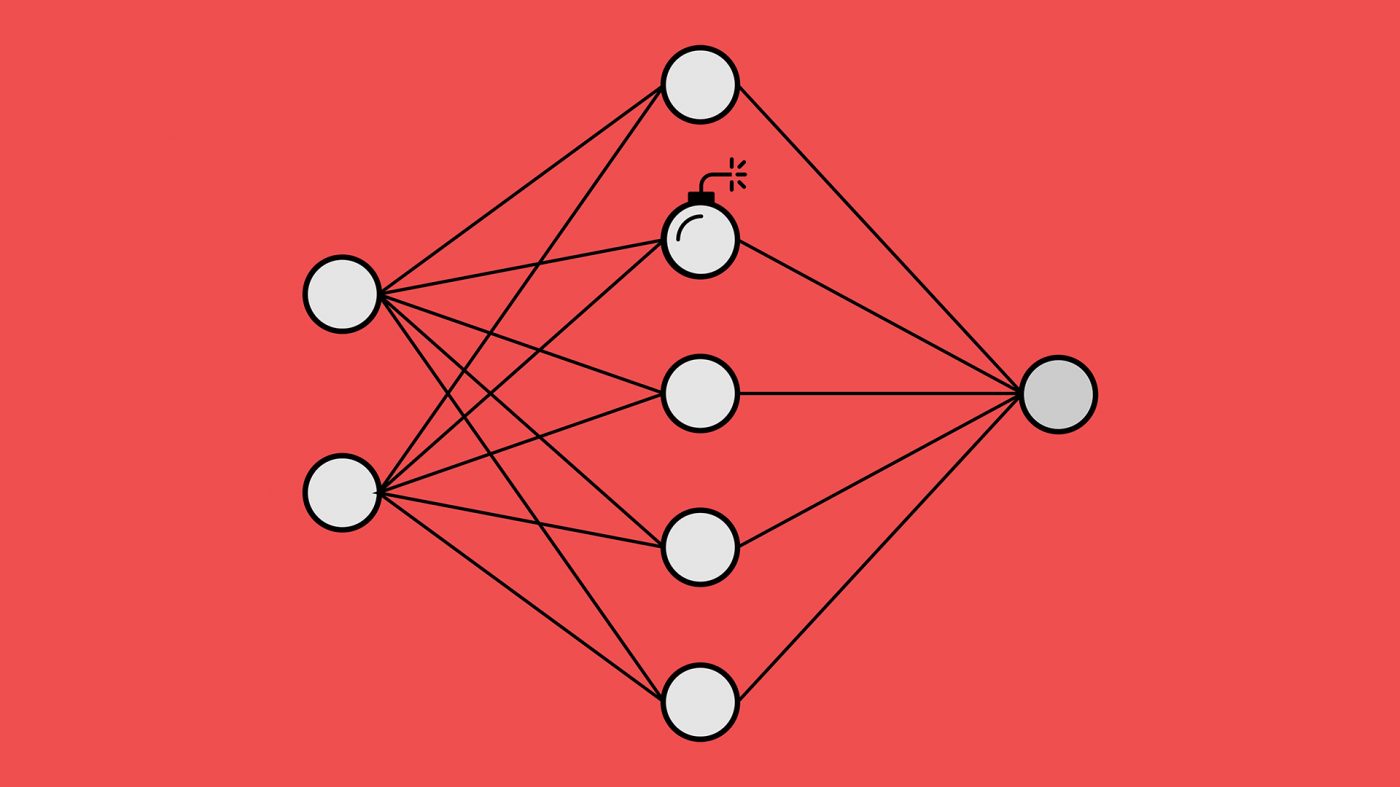

ニューラルネット版「トロイの木馬」がAIの時限爆弾になる可能性

ニューラル・ネットワークの内部に隠された悪意のあるコードが、後々になって画像認識アルゴリズム乗っ取ってしまう可能性がある。

画像認識AIを騙すのはそれほど難しくない。たとえば、サイバー攻撃によって、自動運転自動車に停止標識を無視するように仕向けたりすることもできる。だからもし、マルウェアがアルゴリズムに織り込まれ、混乱を引き起こすように事実上プログラムされてしまったとしたら、どうなるのだろうか?

新たに発表された論文では、悪意のあるコードが潜むことで、信頼できるニューラル・ネットワークが汚染される可能性を示している。凶悪なプログラムはニューラル・ネットワークに居座り、何らかのトリガーで起動してシステムを乗っ取り、データを誤って予測したり、分類したりする。

すでに米国政府は、他国で生産されたハードウェアにバックドアが仕込まれ、外国機関がコンピューターのシステムを密かに探ったり、コントロールしたりする可能性があると懸念している。こうした考えはテクノロジーに対する病的な妄想なのだろうか? いや、最新の研究は、人工知能(AI)ですらデジタル版スパイ大作戦から逃れられないことを示唆している。

オープンAIが「年齢予測」導入、子ども保護の責任誰が負う?

オープンAIが「年齢予測」導入、子ども保護の責任誰が負う?

MITの学生は「世界を変える10大技術」から何を学んでいるか?

MITの学生は「世界を変える10大技術」から何を学んでいるか?

eムック 『世界を変える10大技術[2026年版]』特集号

eムック 『世界を変える10大技術[2026年版]』特集号

期待外れのCRISPR治療、包括的承認で普及目指す新興企業

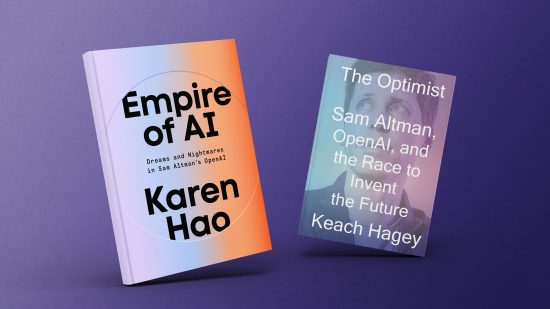

期待外れのCRISPR治療、包括的承認で普及目指す新興企業 書評:サム・アルトマンはいかにして「AI帝国」を築いたか

書評:サム・アルトマンはいかにして「AI帝国」を築いたか