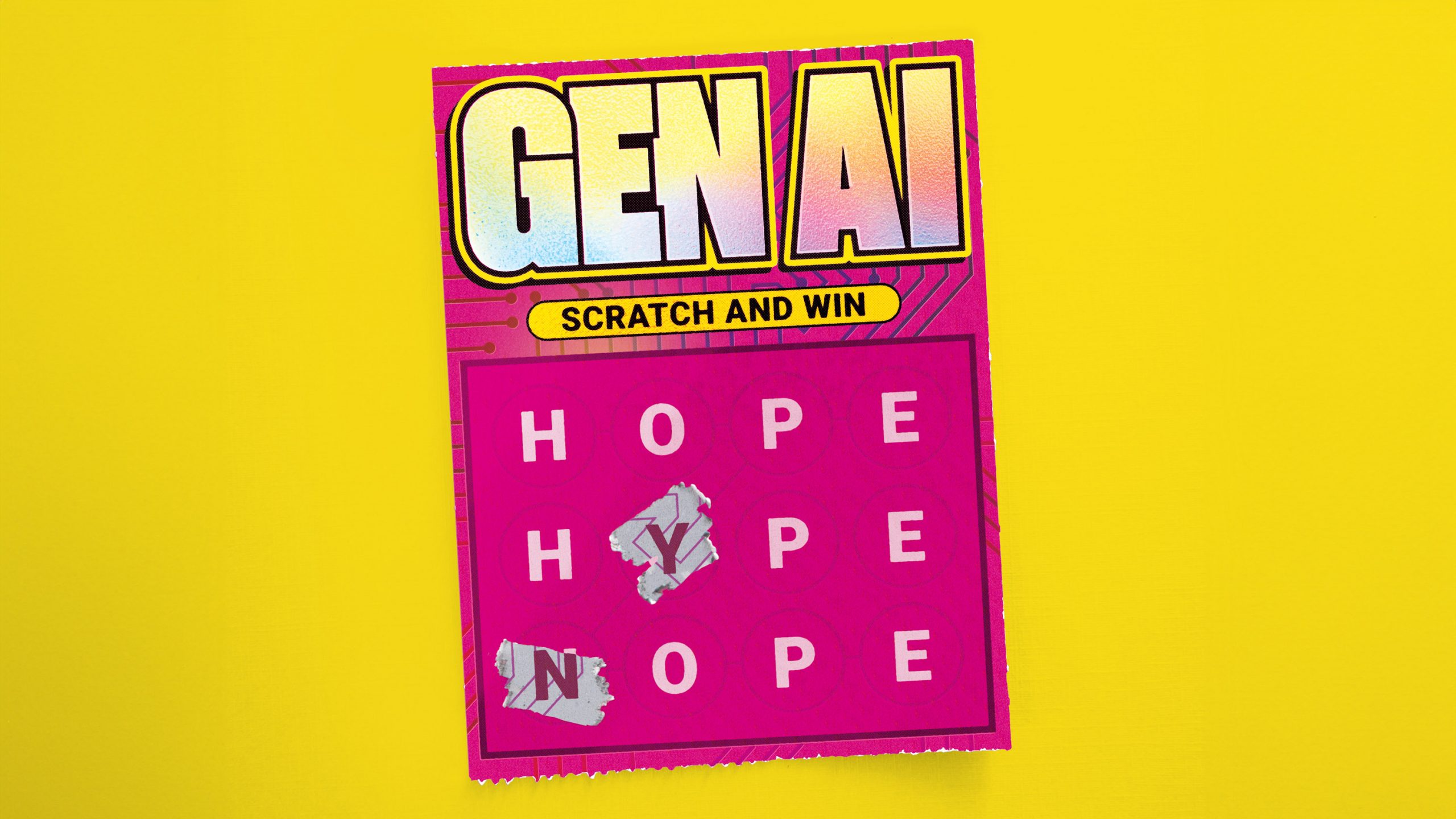

生成AI革命で残された

6つの課題

2023年、生成AIは世界を席巻したが、未解決の問題も残っている。生成AIの未来、そして私たちの未来は、私たちが次にどうするかで決まってくるだろう。 by Will Douglas Heaven2024.01.09

2023年のトレンドの変化の大きさを私に初めて教えてくれたのは、見ず知らずの人であった。3月のことだ。なかなか来ないエレベーターを待っていたとき、たまたま居合わせたある女性は、チャットGPT(ChatGPT)を使って、マーケティングの仕事の報告書を書く手伝いをしてもらったと話してくれた。彼女は、報告書の作成があまり得意でないと思っており、書くことが嫌いだった。だが、今回はマネージャーが褒めてくれたのだそうだ。「ズルをしている気分でしたか?」と私が尋ねると、「とんでもない」と彼女は答えた。「仕事をこなすためなら、使えるものは使います」。

この女性の生成AI(ジェネレーティブAI)の経験は、数多ある例のひとつである。いま、街中(そしてエレベーターの中)にいる人たちは、この斬新なテクノロジーが何のためにあるのかを理解しようとし、どんなことに使えるかを考えている。現在、生成AIをめぐる喧伝は、いろんな意味でインターネットの黎明期を彷彿とさせる。そこには興奮や期待感、そして前に進みながら作り上げているという感覚がある。

言うなれば、私たちはいま、2000年頃のドットコムバブルの最中にいるのと同じなのだ。この先、多くの企業が破綻するだろう。この時代のフェイスブック(現メタ)、ツイッター(現「X」)、ティックトック(TikTok)が出現するまで、何年もかかるかもしれない。「人々は10年後の未来を想像したがりません。誰も愚か者と思われたくないからです」。テクノロジー・コンサルティング会社ブーズ・アレン・ハミルトン(Booz Allen Hamilton)で生成AI部門の責任者を務めるアリソン・スミスは言う。「でも、それは私たちの予想を大きく超えるものになると思います」。

インターネットは、私たちの仕事のやり方や遊び方、友人や家族との過ごし方、学び方、消費の仕方、恋愛のやり方など、あらゆることを変えた。その一方で、ネットいじめやリベンジポルノ、トロール・ファクトリー(デマ発信組織)が出現した。インターネットは大量虐殺を促し、メンタルヘルス危機を煽った。さらに、中毒性のあるアルゴリズムと略奪的な広告を駆使した監視資本主義を誕生させ、これは現代の支配的な市場勢力となっている。こうしたデメリットが明らかになったのは、膨大な数の人々がインターネットを使い始め、ソーシャルメディアのようなキラーアプリが登場してからだ。

生成AIも同じ道をたどる可能性が高い。オープンAI(OpenAI)、グーグル、メタなどが、いくつかの基盤生成モデルというインフラを整備し、その構築に携わっていない人たちが、作成者が夢にも思わなかった形で、このインフラの利用や悪用を始めることになる。「個々のユーザーに実際に試してもらわないと、その可能性とリスクを完全に把握することはできません」とスミスは言う。

生成AIはインターネット上のコンテンツで訓練されているため、バイアス、誤った情報、著作権侵害、人権侵害、あらゆる面での経済的混乱に関するものなど、未解決の問題の多くを引き継いでいる。とはいえ、闇雲に進もうとしているわけではない。

生成AI革命の展開を観察するうえで、心に留めておくべき6つの未解決の疑問を見ていこう。インターネット革命の失敗を踏まえて、今回はもっと上手くやるチャンスが私たちにはある。

1. バイアスの問題がなくなる日は来るのか?

バイアスが人工知能(AI)関連の害悪の代名詞となっているのには、相応の理由がある。現実世界のデータ、特にインターネットから収集したテキストや画像は、性別をめぐる固定観念から人種差別に至るまで、バイアスに満ちあふれている。それらデータに基づいて訓練されたモデルは、そうしたバイアスがエンコードされており、どこで使われようと様々なバイアスを強化する方向に働く。

チャットボットや画像生成AIは、エンジニアを白人男性、看護師を白人女性として表現する傾向がある。黒人は、警察の顔認識プログラムによって誤認され、不当逮捕に見舞われるリスクを抱えている。人材採用アルゴリズムは、女性よりも男性を好む傾向があり、しばしばその対処のために取り入れられるアルゴリズムによって、バイアスが強化されている。

新しいデータセットやモデルの新しい訓練方法(どちらもその準備に何年もかかる可能性がある)がなければ、バイアス問題の根本原因は依然として残ることになる。しかし、これが注目の研究テーマであることに変わりはない。オープンAIは、人間のフィードバックによる強化学習(RLHF:Reinforcement Learning from Human Feedback)などの手法を使って、大規模言語モデルのバイアスを減らすことに取り組んでいる。これにより、人間のテスターが好ましいと思うようなテキストを出力するようにモデルが方向付けられる。

他の手法としては、合成データセットの使用が挙げられる。たとえば、映像制作用の生成モデルを構築するスタートアップ企業であるランウェイ(Runway)は、民族、性別、職業、年齢が異なる人々のAI生成画像など、合成データを使って、人気の画像生成モデル「ステーブル・ディフュージョン(Stable Diffusion)」のあるバージョンを訓練している。同社の報告によると、このデータセットで訓練されたモデルでは、肌の色が濃い人の画像や女性の画像がより多く生成される。実業家の画像をリクエストすると、スカーフをかぶった女性の画像が出力されるようになった。また、医師の画像では、肌の色や性別が多様な人たちが描かれるといった具合だ。

評論家らはこれらの対策を、壊れた基本モデルの対処療法に過ぎず、問題の解決ではなく隠蔽であるとして否定している。しかし、ブーズ・アレン・ハミルトンで「責任あるAI」部門を率いるスミスの同僚、ジェフ・シェーファーは、このようなアルゴリズムにおけるバイアスは、長期的には有益な形で社会のバイアスを暴露する可能性があると主張する。

一例として、人種に関する明示的な情報がデータセットから削除されたとしても、人の住所から人種を推測できるため、人種バイアスが依然としてデータに基づく意思決定を歪める可能性がある。これによって人種差別や住宅差別のパターンが明らかになるとシェーファーは指摘する。「大量のデータを1カ所に集めたことで、その相関関係が非常に明確になりました」。

シェーファーは、同様のことがこの世代のAIにも起こる可能性があると考えており、「社会全体に存在するこうしたバイアスが明らかになるでしょう」と言う。そして、それがより的を絞った政策立案につながるだろうと語る。

しかし、多くの人はそのような楽観主義に渋い顔をするだろう。問題が公けになったからといって、それが解決される保証はない。政策立案者たちは、住宅、雇用、融資、治安維持などの面で、数年前に露呈した社会的バイアスに今も対処しようとしている。その間、人はそれを受け入れて生活することになる。

予測:バイアスは、ほとんどの生成AIモデルに内在する特性であり続けるだろう。しかし、次善策と認識の広がりは、政策立案者が最も明白なバイアスに対処するうえでの助けとなるかもしれない。

2. AIで著作権の扱いがどう変わるのか?

テック企業が同意なしに作品から利益を得ることに憤慨したアーティストや作家(およびプログラマー)らは、著作権侵害を主張して、オープンAIやマイクロソフトなどを相手取って集団訴訟を起こしている。ゲッティ(Getty)は、画像生成モデルのStable Diffusionを提供するスタビリティAI(Stability AI)を訴えている。

これらは大きな問題となっており、サラ・シルバーマンやジョージ・R・R・マーティンなどの著名人が原告となり、メディアの関心を集めている。こうした訴訟により、少なくとも米国では、他者の作品の何がフェアユースで、何がそうでないないかに関する規則が書き換えられことになりそうだ。

しかし、期待は禁物だ。280社以上のAI企業の代理人を務めるガンダーソン・デットマー(Gunderson Dettmer)法律事務所で、知的財産ライセンス専門パートナーのケイティ・ガードナーは、裁判所が最終決定を下すまでには何年もかかるだろうと話す。最終決定が下るころには、「このテクノロジーは経済にしっかりと定着し、元に戻すことはできなくなっているでしょう」と彼女は言う。

その一方で、テック業界はこのような侵害疑惑を猛スピードで積み上げていっている。「企業が様子見をするとは思えません」とガードナーは言う。「ある程度の法的リスクはあるかもしれません。しかし、それ以外に、追従しないことによるリスクも、たいへん多く存在するのです」。

侵害の可能性を制限する対策を講じている企業もある。オープンAIとメタは、クリエイターが将来のデータセットから自分の作品を削除できる方法を導入したと主張している。オープンAIは現在、「DALL-E(ダリー)」のユーザーが、生存中のアーティストのスタイルで画像をリクエストできないようにしている。しかし、「これらはすべて、訴訟で自分たちの主張をサポートするための措置です」とガードナーは話す。

現在、グーグル、マイクロソフト、オープンAIは、自社モデルのユーザーを潜在的な訴訟から守る姿勢を示している。マイクロソフトは、訓練に使われたコードを作ったソフトウェア開発者らを代表とする集団訴訟の対象となっている生成コーディングアシスタント「ギットハブ・コパイロット(GitHub Copi …

- 人気の記事ランキング

-

- Anthropic’s Code with Claude showed off coding’s future—whether you like it or not 「Claudeに任せてしまおう」 たった1年で激変したソフトウェア開発

- Promotion Call for entries for Innovators Under 35 Japan 2026 「Innovators Under 35 Japan」2026年度候補者募集のお知らせ

- It’s time to address the looming crisis in entry-level work. 「コーディングを学べ」もう通用せず、AIが若者の雇用を奪い始めた

- A reality check on the AI jobs hysteria 「ホワイトカラー消滅」 まだデータに兆候なし ——ただし若者に警戒信号

- Inside the stealthy startup that pitched brainless human clones 「臓器袋」から全身置換へ ステルス企業R3が隠す 「脳なし」クローン計画