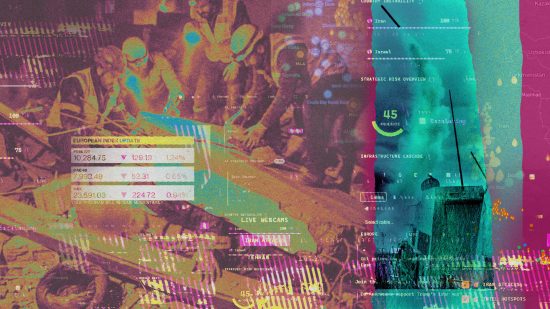

生活保護の嘘を見抜け——

アムステルダムの「完璧」な

AI導入が失敗した理由

オランダのアムステルダム市は生活保護の虚偽申請を検出するAI「スマートチェック」を開発。専門家の助言を受け、バイアス除去や透明性確保など「責任あるAI」の手順を踏んだものの、試験運用で深刻な問題が発生し、導入は中止に追い込まれた。完璧な条件下でも失敗した実験が突きつける、根本問題とは。 by Eileen Guo2025.07.28

- この記事の3つのポイント

-

- アムステルダム市は「責任あるAI」のベストプラクティスをすべて実行したが失敗に終わった

- 技術的調整では解決できない根本的な構造問題が浮き彫りになった

- 「公正なアルゴリズム」という前提そのものに疑問が提起された

2つの未来

体育教師からデジタル著作権擁護者に転身したハンス・デ・ズワルトは、市内のすべての生活保護申請者による不正の可能性をアルゴリズムで評価するというアムステルダム市の計画を見たとき、椅子から転げ落ちそうになったという。

それは2023年2月のことだった。オランダを代表するデジタル著作権NGO「ビッツ・オブ・フリーダム(Bits of Freedom)」の事務局長だったデ・ズワルトは、2年近くにわたりアムステルダム市政府の非公式の顧問を務め、同市が開発していたAIシステムのレビューとフィードバックを実施してきた。

市の文書によれば、「スマートチェック(Smart Check)」と呼ばれるこのAIモデルは、生活保護の潜在的な受給希望者の申請内容を精査し、虚偽の申請をした可能性がある人物を特定するという。デ・ズワルトにとってこのプロジェクトは、これまで関わってきたどの案件よりも強い印象を与えた。しかも、それは良い意味ではなかった。「このアルゴリズムを“実際の人々”に使うことには、非常に根本的かつ修復不能な問題があります」と彼は言う。

福祉国家であるオランダにおいて、さまざまな公的機関での勤務経験を持つアムステルダム市のコンサルタント、ポール・デ・コニングは、市役所の大きく湾曲したガラス窓の奥にある眺望のよいオフィスから、同じシステムを誇らしげに見守ってきた。スマートチェックの試験導入を担当したデ・コニングは、このプロジェクトがアムステルダムの社会給付制度の効率化とバイアス排除に貢献すると考え、期待を寄せていた。

不正調査員とデータ科学者のチームは、スマートチェックの開発に数年を費やしてきた。その初期成果は有望であり、このアプローチの正当性を示していると、デ・コニングは確信していた。アムステルダム市は専門家の助言を仰ぎ、バイアス検証を実施し、技術的な安全策を講じた。また、このプログラムの影響を受ける人々からのフィードバックも収集した。程度の差はあるにせよ、倫理的なAIのガイドラインで推奨されているすべての措置にも従っていた。「よい感触を得ていました」と、デ・コニングは語った。

この2つの相反する視点は、アルゴリズムに人々の人生を左右する意思決定を委ねたとき、それが公正であり得るのかという世界的な議論の典型を示している。このような方法で人工知能(AI)を利用する取り組みが行なわれてきた過去数年の間、巻き添え被害を被る事例が増えていった。米国では非白人の申請者が求職応募者の母集団から除外され、日本では誤って児童虐待調査の対象に選ばれる家庭が出た。またインドでは、低所得の住民が食糧助成金の支給を拒否された。

こうした評価システムの支持者たちは、限られたリソースより多くの成果を上げ、より効率的な公共サービスを作り出すことができると主張する。特に福祉システムの場合は、公的資金から喪失しているとされる資金を取り戻せるという。しかし実際には、その多くが最初から設計が甘かった。時には差別につながるような方法で、個人的特徴が組み入れられることがある。また、バイアスや有効性の検証を経ないまま導入された例もあった。さらに、生活に直接影響を与える自動化された評価に対し、人々が異議を申し立てるための選択肢も、それを理解するための選択肢も、ほとんど提供されていない。

その結果、10年以上にわたって不祥事が相次いだ。これに対応し、アムステルダムやニューヨーク、ソウル、メキシコシティなどの都市の立法者、官僚、民間セクターの関係者たちは、「責任あるAI」の原則を取り入れたアルゴリズム・システムを構築することで、罪滅ぼしをしようとしてきた。このアプローチは、悪影響を最小限に抑えながら社会に利益をもたらすAI開発の手引となることを目指すものである。

倫理的なAIの開発と展開は、欧州連合(EU)にとって最優先課題である。これは、AI権利章典の枠組みを発表したジョー・バイデン前大統領政権下の米国でも同様だった。だがその計画は、トランプ政権によって破棄され、テクノロジー分野を含め、衡平性や公正性への配慮は国家レベルで排除されてしまった。それにもかかわらず、こうした原則に影響を受けたシステムは今なお、米国の内外を問わず、国、州、県、市の指導者たちによって試験的に運用されている。彼らは、どの人物を雇うべきかということや、児童虐待の可能性があるケースをどのタイミングで調査するかということ、最初にサービスを受けるべきなのはどの住民かといったようなことを決定する、非常に大きな権限を有している。

アムステルダム市は確かに、正しい道を歩んでいると考えていた。福祉部門の市職員たちは、市民の権利を守りつつ、不正を防止するテクノロジーを構築できると信じていた。彼らは新たに確立されつつあるベストプラクティスに従い、最終的に実際の生活保護申請を処理することになるプロジェクトに、莫大な時間と資金を投じた。しかし試験運用の段階で、彼らが構築したシステムは依然として、公正でも効果的でもないことが明らかになった。なぜそうなったのか?

ライトハウス・レポーツ(Lighthouse Reports)、MITテクノロジーレビュー、オランダの新聞トラウ(Trouw)の共同取材班は、このシステムに対する前例のないアクセス権を得て、その実態の解明に取り組んできた。アムステルダム市は公文書開示請求に応じ、スマートチェックの複数のバージョンと、実際の生活保護申請者をどのように評価したかに関するデータを開示した。これにより私たちは、理想的な条件下において、このアルゴリズム・システムがその野心的な約束を本当に果たせるのかという点について、独自の洞察を得ることができた。

その疑問に対する答えは、決して単純ではない。デ・コニングにとってスマートチェックは、より公平で透明性の高い福祉制度への技術的進歩を象徴していた。一方、デ・ズワルトにとってそれは、いかに技術的に調整を加えようとも解消できない、生活保護受給者の権利に対する重大なリスクを意味していた。このアルゴリズム実験が数年にわたって続けられる中で、プロジェクトの中核となる前提——すなわち、「責任あるAI」が単なる理念や企業の売り文句にとどまらず、現実世界でアルゴリズムを公正なものにできるという考え——そのものが疑問視されるようになったのだ。

贖罪のチャンス

アムステルダム市がAIを活用した不正防止に取り組むことになった経緯を理解するには、40年前に起きた、生活保護に関するあまりにひどい国家的不祥事まで遡る必要がある。

1984年、離婚して3人の子どもを育てていたアルビーネ・グルンベックは、数年前から生活保護を受けていた。あるとき、地元の福祉事務所に勤める隣人が、彼女の生活を密かに監視していたことを知る。その隣人は、理論上は未申告収入と見なされる可能性のある、男友達の訪問を記録していた。この観察記録に基づいて、福祉事務所はグルンベックの支給額を減額した。彼女はその決定を裁判で争い、勝訴した。

グルンベックの個人的な正当性が認められたにもかかわらず、オランダの福祉政策は、人々の生活を調べ回る権限を「歯ブラシカウンター」と揶揄される福祉詐欺調査員に与え続けてきた。これは疑心暗鬼の空気を生み出し、行政と市民の双方に問題をもたらしてきたと語るのは、オランダで数十年にわたり生活保護受給者を支援してきたマルク・ファン・フーフ弁護士である。「政府は国民を信用しておらず、国民も政府を信用していないのです」。

キャリア公務員のハリー・ボダールは、ソーシャルワーカー、不正調査員、そして現在の市の福祉政策顧問として、長年オランダの福祉政策の現場を見つめてきた。過去30年を振り返って、「福祉制度は輪ゴムとホッチキスでかろうじてつながっているようなもの」とボダールは語る。「そして、その制度の最下層にいる人々こそ、真っ先にその隙間からこぼれ落ちるのです」。

アムステルダム市が2019年にスマートチェックの設計を開始したとき、福祉制度を受給者にとってより機能的なものに改善することが、強い動機のひとつだったとボダールは説明する。「本当に確認が必要だと思われる人たちだけに、公正なチェックをしたかったのです」。2007年まで実施されていた、申請者全員に対する家庭訪問という従来の福祉部門の方針とは対照的だった。

しかしボダールはまた、オランダが問題を抱えた福祉AI導入の「震源地」のような存在になっていることも理解していた。オランダ政府がAIを活用して不正検出を近代化しようとした複数の試みが、むしろ逆効果となり、悪名高い事例として記憶されていたからだ。

2019年には、国が児童扶養手当制度の不正を見抜くためにアルゴリズムを用いてリスク・プロファイルを作成していたことが発覚した。その結果、約6年間で3万5000人近くの親たちが、支援制度を不正利用したとして誤って告発された。彼らの多くは移民、または移民の子どもだった。このスキャンダルによって多くの家庭が借金を抱え、一部は貧困に追い込まれ、最終的には2021年に内閣が総辞職する事態に至った。

ロッテルダム市では、2023年にライトハウス・レポーツが実施した福祉詐欺検知システムに対する調査で、女性や親、オランダ語を母語としない人々といった社会的に弱い立場の人々に対しバイアスがかかっていることが明らかになった。最終的に同市はこのシステムの使用を中止せざるを得なかった。アムステルダムやライデンといった他の都市では、「不正スコアカード」と呼ばれるシステムを使用していた。これは20年以上前に初めて導入されたもので、学歴や居住地域、親であるかどうか、ジェンダーなどを、生活保護申請者を評価するための粗雑なリスク要因として扱っていた。このプログラムもすでに運用を打ち切られている。

こうした問題はオランダに限った話ではない。非営利団体「ベネフィッツ・テック・アドボカシー・ハブ(Benefits Tech Advocacy Hub)」によると、米国では州政府が公的給付金の分配を支援する目的でアルゴリズムを使用した事例が少なくとも11件あり、多くの場合で問題を引き起こしている。たとえばミシガン州では、4万人を失業保険詐欺に関与したとして誤って告発した。またフランスでは、活動家たちが国の福祉当局を訴えており、そのアルゴリズムが低所得層や障害者を差別していると主張している。

こうした一連の不祥事に加え、アルゴリズムシステムに人種差別が組み込まれる可能性への認識が高まったことにより、「責任あるAI」を重視する動きが加速した。責任あるAIとは、「倫理だけでなく、衡平性も考慮する必要がある」と表明する包括的な用語になったと語るのは、民間企業や自治体の両方に対してAI監査を提供してきた倫理的AIコンサルタントのジアハオ・チェンである。「透明性やプライバシー、セキュリティ、安全性などが必要だという認識が広がってきていると思います」。

拡大し続けるテクノロジーが引き起こす害を抑えるための一連の施策を基盤とするこのアプローチは、ある種お決まりのパターンに従って、急成長中の分野を形成している。シンクタンクや国際機関による白書やフレームワーク、5大コンサルティング企業のような伝統的な有力企業、そして新興企業や非営利団体などで構成される収益性の高いコンサルティング業界がそれを支えている。たとえば2019年には、経済協力開発機構(OECD)が「信頼できるAI」の開発を目的とした指針「AI原則」を発表しており、その中には説明可能なシステムの構築、利害関係者との対話、監査の実施などが含まれている。

しかし、数十年にわたるアルゴリズムによる不正使用の歴史は、いまだに影を落としている。そして、公正と不公正の線引きについて合意が得られることはほとんどない。オランダが国家レベルで責任あるAIによる制度改革を進める一方で、政府省庁向けに倫理的AIの監査サービスを提供してきたNGO「アルゴリズム・オーディット(Algorithm Audit)」は、生活保護受給者のプロファイリングにアルゴリズムを使用する場合は、厳格に定義された条件下でのみ認められるべきであり、ジェンダーなどの保護属性を一切考慮しない設計でなければならないと結論づけている。一方、アムネスティ・インターナショナル、デ・ズワルトをはじめとするデジタル権利擁護者たち、そして一部の生活保護受給者は、人々の生活に関する意思決定においては、公共セクターはAIを一切使用すべきでないと主張している。

アムステルダム市は、今回こそ適切なバランスを見つけられたと信じた。「私たちは、これまでに起きたことから学んできました」と、政策顧問のボダールは過去の不祥事について語る。そして今回は、「私たちが善良で、公正であるということをアムステルダム市民に示す」システムを作りたいと考えたのだ。

より良い方法を見つける

アムステルダムの住民が給付金を申請するたびに、ケースワーカーが申請内容に不備や不審点がないかを確認する。不審と判断された場合、その申請は市の調査部門に送られ、却下されたり、書類の訂正を求められたり、給付額の減額が勧告されたりす …

- 人気の記事ランキング

-

- This company claims a battery breakthrough. Now they need to prove it. すべてのパラメーターが矛盾——「出来すぎ」全固体電池は本物か?

- OpenAI’s “compromise” with the Pentagon is what Anthropic feared アンソロピック排除の裏で進んだオープンAIの軍事契約、その代償は

- AI is rewiring how the world’s best Go players think 「アルファ碁」から10年、 AIは囲碁から 創造性を奪ったのか

- How uncrewed narco subs could transform the Colombian drug trade 中には誰もいなかった—— コカイン密輸組織が作った 「自律潜水ドローン」の脅威