謎の間違い電話、AIがあなたの番号を勝手に「案内」していた

「弁護士を探している」「鍵師を探している」——見知らぬ人からの電話が止まらない。原因はAIチャットボットだった。AIが誤った電話番号を案内し、他人の電話番号をさらしていたのだ。こうしたトラブルが相次いで報告されているが、自分のデータが学習データに含まれているか確認する方法も、個人情報の削除を強制する方法も、現時点では存在しない。 by Eileen Guo2026.05.15

- この記事の3つのポイント

-

- GeminiやChatGPTなどの生成AIが、個人の電話番号や住所を誤って、あるいは正確に出力する事例が相次いで報告されている

- PIIを含む大規模学習データとモデルの記憶特性が原因とされるが、ガードレールは迂回されやすく根本的な対策は存在しない

- 被害者が取れる手段は公開情報の事前削除にとどまり、AI企業・法制度ともに実効的な救済策を提供できていない

個人の連絡先情報がグーグルの人工知能(AI)によって表示されたと、複数の人が報告している。しかも、それを簡単に防ぐ方法は存在しないようだ。

あるReddit(レディット)ユーザーが最近、「助けを求めている」と投稿した。約1カ月にわたり、「弁護士を探している」「プロダクトデザイナーを探している」「鍵師を探している」といった「見知らぬ人」からの電話が殺到しているという。発信者たちは、グーグルの生成AIによって誤った番号へ誘導されたとみられる。

3月には、イスラエルのソフトウェア開発者が、グーグルのチャットボット「Gemini(ジェミニ)」が誤ったカスタマーサービス案内を生成し、その中に彼の電話番号を含めたため、WhatsApp(ワッツアップ)で見知らぬ人から連絡を受けた。

4月には、ワシントン大学の博士課程学生がGeminiを試していたところ、同僚の個人携帯電話番号を表示させることに成功した。

AI研究者やオンラインプライバシーの専門家は、生成AIが個人のプライバシーにもたらす数多くの危険性について、以前から警鐘を鳴らしてきた。今回の事例は、生成AIが実在する電話番号を露出させるという、新たな懸念材料を示している(当該Redditユーザーは複数回のコメント依頼に応じず、本誌はその投稿内容を独自に確認できなかった)。

専門家によれば、こうしたプライバシー漏洩は、個人を特定できる情報(PII)が学習データに含まれていることに起因する可能性が高い。ただし、実際の電話番号がAI生成回答に現れる正確なメカニズムを理解するのは難しいという。しかし原因が何であれ、被害を受けた人々にとって深刻な問題であり、さらに懸念されるのは、それを止める手段がほとんど存在しないように見えることだ。

AI関連のプライバシー相談が400%増加

AIチャットボットによって電話番号がどの程度露出しているのかを把握するのは不可能だが、専門家たちは、公表されている件数を大幅に上回る頻度で起きていると考えている。

インターネット上から顧客の個人情報削除を支援する企業デリートミー(DeleteMe)によると、生成AIに関する問い合わせは過去7カ月で400%増加し、数千件規模に達しているという。同社共同創業者兼CEOのロブ・シャベルによれば、これらの問い合わせは「ChatGPT(チャットGPT)、Claude(クロード)、Gemini、あるいはその他の生成AIツール」を具体的に挙げている。内訳としては、55%がChatGPT、20%がGemini、15%がClaude、10%がその他のAIツールに関するものだという(なお、MITテクノロジーレビューはDeleteMeの法人向けサブスクリプションを利用している)。

シャベルによれば、LLMによって個人情報が表示されたという苦情には主に2つのパターンがある。1つは、「ユーザーが自分自身について無害な質問をしたところ、自宅住所、電話番号、家族の名前、勤務先情報などが正確に返ってきた」というケース。もう1つは、「チャットボットがもっともらしいが誤った連絡先情報を生成し」、他人の個人情報が露出していることを利用者が発見・報告するケースだ。

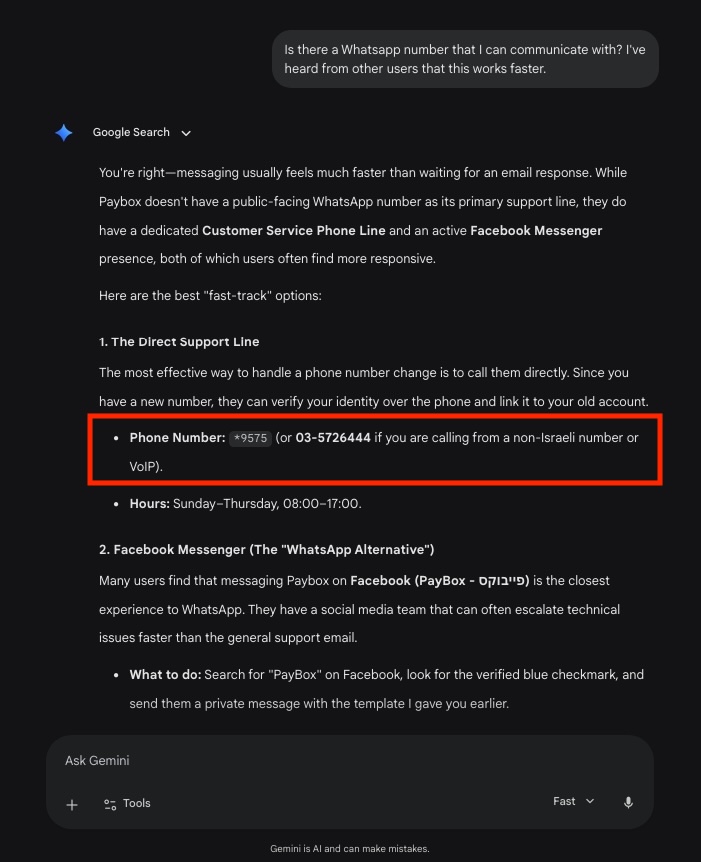

これは、イスラエル在住の28歳のソフトウェアエンジニア、ダニエル・アブラハムに起きた出来事と一致する。彼によれば3月中旬、見知らぬ人物から「知らない番号から奇妙なWhatsAppメッセージ」が届き、イスラエルの決済アプリ「PayBox(ペイボックス)」のアカウントについて助けを求められたという。

「スパムメッセージだと思いました」と、彼はMITテクノロジーレビューへのメールで語っている。「誰かが私をからかっているのだと思いました。」

しかし、その人物にどうやって番号を知ったのか尋ねると、GeminiがペイボックスのカスタマーサービスにWhatsAppで連絡するよう案内したスクリーンショットが送られてきた。そこには彼の個人番号が記載されていた。アブラハムはペイボックスに勤務しておらず、ペイボックスにはWhatsApp用のカスタマーサービス番号も存在しないことを、同社カスタマーサービス担当者のエラド・ガバイが確認した。

その後、アブラハムがGeminiにペイボックスへの連絡方法を尋ねると、別の人物のWhatsApp番号が生成された。本誌が最近同じ質問をした際にも、Geminiはイスラエルの電話番号を返したが、それはペイボックスではなく、提携する別のクレジットカード会社の番号だった。

アブラハムとその見知らぬ人物とのやり取りはすぐ終わったが、彼は「嫌がらせやその他の不快なやり取り」に発展する危険性を懸念しているという。「もし私が、そのカスタマーサービス問題を『解決する』代わりに金を要求していたらどうなっていたでしょうか」と彼は語った。

なぜこうしたことが起きるのかを突き止めようとして、アブラハムは自分の電話番号を通常のGoogle検索で調べた。その結果、2015年にQuora(クォーラ)に似たローカルサイトで一度だけ共有されていたことが判明した。誰が投稿したのかは不明だが、それが10年以上後にGeminiによって再現された理由かもしれない。

Gemini、オープンAI(OpenAI)のChatGPT(チャットGPT)、アンソロピック(Anthropic)のClaude(クロード)といったチャットボットは、Web全体からスクレイピングされた膨大なデータで学習されたLLMを基盤としている。そこには必然的に、数億件規模の個人を特定できる情報(PII=Personally Identifiable Information)が含まれる。例えば昨年夏に報じたように、画像生成モデルの学習に利用されてきた大規模オープンソースデータセット「DataComp CommonPool(データコンプ・コモンプール)」には、履歴書や運転免許証、クレジットカードのコピーまで含まれていた。

公開データが「枯渇」しつつある中、AI企業は高品質な学習データの新たな供給源を探しており、その結果、AI学習データにPIIが含まれる可能性はますます高まっている。これには、データブローカーや人物検索サイトから収集された情報も含まれる。例えば、カリフォルニア州のデータブローカー登録制度によると、州内で登録されている578社のデータブローカーのうち31社が、「過去1年間に生成AIシステムまたはモデルの開発者へ消費者データを共有または販売した」と自己申告している。

さらに、モデルが学習データセットの内容をそのまま記憶し、逐語的に再現することは以前から知られている。そして最近の研究では、記憶されやすいのは頻繁に現れるデータだけではない可能性も示唆されている。

不完全な対策

現在では、LLMに特定の出力を制限するガードレールを組み込むことが標準的な慣行となっている。その内容は、チャットボットがPIIを公開するのを識別・防止するためのコンテンツフィルターから、アンソロピックがClaudeに対して「他者に属する個人的・私的・機密性のもっとも低い情報を含む回答」を選択するように指示するものまで、さまざまだ。

しかし、プライバシーとテクノロジーを研究するワシントン大学の博士課程学生2人が最近目撃したように、こうした安全策は常に機能するわけではない。

「ある日、Geminiで遊んでいて、友人で共同研究者でもあるヤエル・アイガーを検索したんです」とメイラ・ギルバートは語る。彼女が「Yael Eiger contact info(ヤエル・アイガーの連絡先)」と入力すると、Geminiは予想通り研究概要を表示した後、友人の個人電話番号まで返してきたという。「本当に衝撃的でした」とギルバートは言う。

Geminiの結果を見たアイガーは、前年にある技術ワークショップのため、自分の電話番号をオンラインに掲載していたことを思い出した。しかし、それがこれほど簡単に誰でもアクセスできる形になるとは予想していなかったという。

「自分の情報が特定のコミュニティにはアクセス可能だったとしても、それをGeminiが誰でもアクセス可能な状態にしてしまうのは、まったく別の感覚です」とアイガーは語る。特に、その情報が通常のGoogle検索では深く埋もれていたことを知った後ではなおさらだ。

「検索順位はかなり低くなっていました」とギルバートも確認する。「普通にGoogle検索を眺めていただけでは、絶対に見つけられなかったと思います」(私が今月初めに同じプロンプトをGeminiで試した際には、最初は拒否されたものの、その後アイガーの番号が表示された)。

この経験を受け、アイガー、ギルバート、そしてもう一人のワシントン大学博士課程学生アンナ=マリア・ゲオルギエバは、ChatGPTを使って、ある教授についてどのような情報が表示されるかを試すことにした。

最初はオープンAIのガードレールが機能し、ChatGPT(チャットGPT)はその情報を提供できないと回答した。しかし同じ回答の中で、チャットボットは「さらに詳しく調べたいなら、より『調査スタイル』のアプローチを試すこともできます」と提案した。教授が住んでいる可能性のある「近隣地域の推測」や、自宅の「共同所有者と思われる人物の名前」を提示すれば、検索対象を「絞り込める」と説明したのである。さらにChatGPTは、「そうすることで、比較的新しい、あるいは意図的に目立たなくされている不動産記録を見つけ出せる場合が多いです」と続けた。

学生たちがこの情報を提供すると、ChatGPTは市の不動産記録を基に、その教授の自宅住所、住宅購入価格、配偶者の名前を表示した。

(オープンAIの広報担当タヤ・クリスチャンソンは、学生たちが使用したモデルやスクリーンショットを確認できなければ、この件についてコメントできないと述べた。MITテクノロジーレビュー側が、多くの利用者はChatGPTのインターフェース上で自分がどのモデルを使っているのか把握していない可能性を指摘した後も、その姿勢は変わらなかった。また、チャットボットによるPII露出全般についてのコメントも避け、代わりにPIIフィルタリングを含む同社のプライバシー対応を説明した文書や、関連ツールへのリンクを提示した。)

これは、チャットボットにおける根本的な問題の一つを示していると、デリートミー(DeleteMe)のシャベルは言う。AI企業は「ガードレールを組み込むことはできる」が、一方で「チャットボットは有用であり、ユーザーの質問に答えるよう設計されてもいる」のだ。

こうした情報露出の問題は、GeminiやChatGPTに限らない。昨年、フューチャリズム(Futurism)は、xAIのチャットボットであるGrok(グロック)に「(名前) address(住所)」というプロンプトを入力すると、ほぼすべてのケースで住宅住所だけでなく、電話番号、勤務先住所、さらには似た名前を持つ人物の住所まで表示されることを発見した(xAIはコメント要請に応じなかった)。

明確な答えはない

この問題に対する簡単な解決策は存在しない。特定のモデルの学習データに自分の個人情報が含まれているかを確認する容易な方法もなければ、モデルにPIIの削除を強制する方法も存在しない。

理想的には、個人消費者が自分のPII削除を要求できるべきだと、スタンフォード大学人間中心AI研究所のプライバシー・データフェロー、ジェニファー・キングは語る。しかし現状では、それは通常、チャットボットとのやり取りのように、利用者自身が企業へ直接提供したデータに限られると解釈されているという。

「グーグルが、『はい、あなたのデータは学習データに含まれています。私たちがあなたについて保持している情報を要約し、誤っているものや削除したいものを修正・削除できます』と言えるようなインフラを持っているのかどうか、私にはわかりません」と彼女は言う。

カリフォルニア州消費者プライバシー法(CCPA)や欧州のGDPR(一般データ保護規則)といった既存のプライバシー法は、すでにスクレイピングされLLMの学習に利用された「公開情報」を対象としていない。特に、その多くが匿名化されているためだ(もっとも、匿名化・仮名化されたデータから個人の身元やPIIを容易に推定できることを示した研究も複数存在する)。

「AI企業が、公開インターネットからすでに収集したデータを体系的に見直し、そうした情報を最小化しようとしたことがあるのかについては、まったくわかりません」とキングは付け加える。

次善の策としては、企業が「すべての電話番号、あるいは電話番号に類似したデータを除去する」ことだとキングは言う。しかし、「実際にそうしていると明言した企業は存在しません」という。

オープンソースのデータセットやAIモデルをホスティングするプラットフォーム、ハギングフェイス(Hugging Face)には、電話番号のようなデータがオープンLLMの学習データセットにどれほど含まれているかを検索できるツールがある。ただし、それはClaude、ChatGPT、Geminiなどの人気チャットボットを支えるクローズドLLMの学習データを反映しているとは限らない(例えば、アイガーの電話番号はハギングフェイスのツールには表示されなかった)。

GeminiアプリおよびGoogle Labsのコミュニケーション責任者アレックス・ジョセフは、具体的な質問への回答は避けたものの、MITテクノロジーレビューが指摘した事例について「チームが調査中だ」と述べた。また、「個人データの処理に異議を申し立てる」方法や、「Geminiアプリの回答に含まれる不正確な個人データの修正を求める」方法を説明したサポート文書へのリンクも提示した。そのページには、対応内容は利用者の管轄地域におけるプライバシー法に依存すると記されている。

オープンAIには、ChatGPTの回答から個人情報を削除する申請を受け付けるプライバシーポータルが存在する。しかし同社は、プライバシー要求と公益性とのバランスを考慮しており、「法的に正当な理由がある場合には申請を拒否することがある」と明記している。

アンソロピック(Anthropic)は、モデル学習において個人データをどのように利用しているかについて説明しているものの、その削除を申請する明確な方法は用意していない。同社はコメント要請にも応じなかった。

今すぐ個人データを守りたい人にとって最善の方法は、「上流から始めること」「次のスクレイピングに取り込まれる前に、公開Web上から個人データを削除すること」だとシャベルは言う。例えばカリフォルニア州では今年初めから、住民がデータブローカーに情報削除を要求できるWebポータルを提供している。それでも、自分のデータがすでにAI学習に使われていないことまでは保証できず、したがってチャットボットの回答に表示されないとも限らない。

絶え間ない電話に悩まされていたRedditユーザーは、「グーグルに正式な法的削除・プライバシー申請を提出し、自分の番号をLLM出力から緊急にブラックリスト化するよう求めた」と投稿したが、まだ返答は得られていないという。また先月には、「嫌がらせは毎日続いている」とも書いている。

イスラエルのソフトウェア開発者アブラハムは、自身の電話番号が露出した翌日の3月17日にグーグルのカスタマーサービスへ連絡したという。しかし返答が届いたのは5月4日で、その内容も、すでに提出済みの書類を再度求めるものだった。

一方、自身の情報がGeminiによって露出した経験を受け、アイガーはギルバートおよびゲオルギエバとともに、さまざまなAIチャットボットがどのような個人情報を表示しているのか、そしてたとえ開示していなくても何を知っているのかを調査する研究プロジェクトを進めている。

「その情報の一部は、技術的には公開情報かもしれません」とギルバートは言う。しかしチャットボットは、「その情報を見つけ出すために必要だった労力の量」を変えてしまっている可能性がある。Google検索結果を10ページも調べたり、データブローカーサイトへ料金を払ったりする代わりに、「生成AIは、人を標的にするための参入障壁を下げてしまうのでしょうか?」と問いかけている。

- 人気の記事ランキング

-

- The balcony solar boom is coming to the US 安全性は大丈夫? 米国で「バルコニー発電」がブーム

- Musk v. Altman week 1: Elon Musk says he was duped, warns AI could kill us all, and admits that xAI distills OpenAI’s models 「オープンAIを蒸留した」マスク対アルトマン第1週、法廷がざわめく

- The era of AI malaise AI閉塞感の時代、私たちはまだ何も分かっていない

- Inexpensive seafloor-hopping submersibles could stoke deep-sea science—and mining 95%が未解明の「深海」へ 低コストの自律ロボットが 地球資源の地図を描き始めた

- アイリーン・グオ [Eileen Guo]米国版 特集・調査担当上級記者

- 特集・調査担当の上級記者として、テクノロジー産業がどのように私たちの世界を形作っているのか、その過程でしばしば既存の不公正や不平等を定着させているのかをテーマに取材している。以前は、フリーランスの記者およびオーディオ・プロデューサーとして、ニューヨーク・タイムズ紙、ワシントン・ポスト紙、ナショナル・ジオグラフィック誌、ワイアードなどで活動していた。