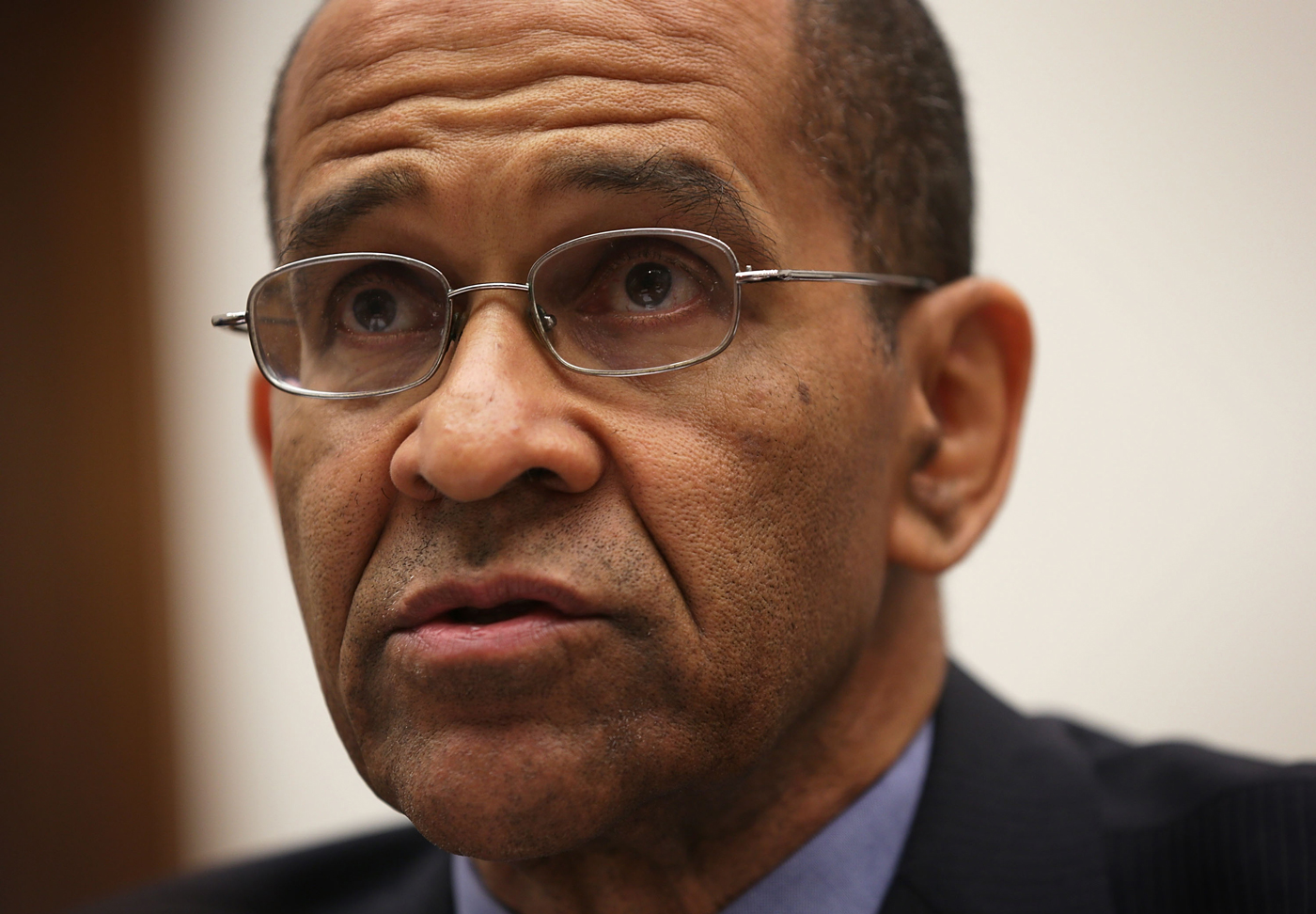

完全自律自動車は実現しない

米政府当局トップが語る

完全自律型自動車は当面実現しない。規制当局トップだからこそ語れる、自動運転と安全の話。 by Andrew Rosenblum2016.09.01

米国では、殺人事件や処方薬の過剰服用による死者数よりも多い、毎年3万3000人以上が自動車事故で亡くなっている。アルファベット(グーグル)やフォードなど、自動運転自動車の開発に取り組む企業は、自社のテクノロジーによって、運転中のメール、飲酒運転、過労時の運転といった人間側の過失をなくし、事故による死者数を大幅に減らせるという。しかし、米国国家運輸安全委員会(NTSB)のクリストファー・ハート委員長は、NTSBが鉄道車両や航空機の自動操縦システムが関わる事故を調査してきた経験から、運転制御から人間の関与は完全になくせない、という。ハート氏はMIT Technology Reviewに、未来の自動車は今よりもずっと安全になるだろうが、それでもなお、「副操縦士」として人間は必要だろうと語った。以下は、インタビュー記録の要約だ。

自動運転自動車が、自動車事故による死者数を減らすことについて、どれだけ前向きにとらえていますか?

私は非常に前向きにとらえています。数十年にわたって、NTSBでは衝突事故の際の負傷を軽減する方法を探してきました。NTSBはシートベルトやエアバッグを義務化し、より頑丈な車体構造を取り入れてきました。そして今や、衝突事故を完全に防止できる可能性が出てきました。その技術が、何万人もの命を救おうとしているのです。どんな衝突事故も起きない。これが、理想的な終着点です。

自動操縦システムには、新たな危険を生む可能性もあります。NTSBは、パイロットが自動化に頼り過ぎることが、墜落事故の原因になってきたとしています。この現象が、自動車の運転でも問題になることを懸念していますか?

私がお話しした、年間数万人の命を守るという理想的なシナリオは、人間が全く関与しない、運転の完全自動化を想定したものです。私たちが、いつ、そこに到達できるのか、私にはわかりません。完全自動化の理想的な形が、近いうちに実現するとは思いません。

運転そのものが好きな人もいます。自動化システムを信頼しない人もいます。そうした人たちは、自分で運転したいと考えるでしょう。それに、運転自動化ソフトが遭遇しうる状況を全て予期できるほどの知性と経験を持つソフトウェア設計者は、世界中どこにもいません。道に飛び込んでくる犬、道に飛び出す歩行者、あるいは自転車、警察官、建設作業員。あるいは、洪水で橋が落ちることもあるでしょう。そうした、あらゆる不測の事態を処理できるシステムは設計できません。

まだ、かなりの部分で人間の手を必要とするような、決して完全ではない自動化システムを使う場合が、問題なのです。ドライバーが車任せにしてしまうことで問題が起きます。機械の技能不足による問題が起きます。ですから、我々の課題は、このようにまとめられます。この、大部分が自動化されたシステムの中で、まだ少し残っている、人間がやらなくてはならない部分がある。長期的に取り組んでいくことになりそうなこの部分を、どのように扱えばいいのか?

最近、テスラの「オートパイロット」機能を使っていたドライバーが亡くなったのは、運転の自動化がうまくいっていなかったせいかもしれません。なぜ、NTSBはこの事故を調査しているのですか?

自動車事故の多くは、NTSBの調査対象にはなりません。NTSBがこの件に関わっているのは、過去の事例から得てきた経験です。NTSBは、複雑な、人間主導のシステムに、自動化を導入している事例を数多く分析してきました。この事故はまさに、それに当てはまるのです。NTSBがこの事故を調査しているのは、自動車の自動化が進みつつあるとNTSBが認識しているからであり、自動化を進める中で起こりうる出来事について、他の自動化システムの事例から得られた知見と共に、周知を促したいと考えるからです。

たとえば、どんな知見がありますか?

そうですね、NTSBは、空港で利用客を輸送するシャトルの事故を調査したことがあります。事故を起こしたシャトルは、別の車両と衝突したんです。NTSBの調査で、原因は整備の問題だとわかりました。人間をシャトルの運行から排除しても、設計や、組み立てや、整備に人が関われば、ヒューマンエラーは起きるのです。

自動運転自動車は、倫理面での決定をしなければならなくなるという話がありますね。たとえば、衝突が避けられない事態になった場合の「トロッコ問題」など。これは実際に、大きな問題になるでしょうか?

各所で話題になっていた例でお話ししましょう。私の車が走っている車線に、36トンのトラックが正面から迫ってきたとします。私の車は、トラックに突っ込んで、運転している私の命を奪うのか、それとも路肩にある歩道に突っ込んで、15人の歩行者の命を奪うのか、決断を迫られます。こうした事態は、システムに織り込まなければならないでしょう。自動車のオーナーを守るのか、それとも他の人を守るのか? 私がこの件について述べるには、連邦政府に問い合わせないといけません。こうした類の倫理的選択は、自動化システムには避けられないでしょう。

問題は、単なる倫理的な選択の場合だけではありません。システムがエラーを起こしたらどうなるでしょう? 自動運転システムは、他の人々、自動車、自転車の被害を最小限に抑えるような形でエラーを起こしてくれるでしょうか? ここにも連邦政府の判断が関わってきます。

検討過程は、どんなものになりうるのでしょうか?

航空分野の場合、連邦航空局(FAA)は、発生確率が10億分の1未満であれば、対策を用意しなくてもよい、という考え方をとっています(飛行機の墜落時に機体の重さを支えられる安全構造は不要)。確率がそれ以上の場合は、安全装置が必要です。飛行機の尾翼に欠陥が生じる確率(尾翼が外れてしまう確率)が10億分の1よりも低いと示せない限りは、それは起こる「見込みがある」とされます。そうなれば、失敗時の方策を用意しなくてはいけません。

自動車の場合にも、同じ検討プロセスが採られるでしょう。連邦政府がこの問題に関わって、こう言うことになると思います。「君たちは、この問題が起きる可能性がX分の1よりも低いと示さなきゃならん。でなきゃ、その問題で人が死なずに済む安全対策を示してもらう必要がある」と。この基準を定める仕事は、各州の政府ではなくて、連邦政府の管轄になるでしょう。50州それぞれに、別々の基準がなくてもいいでしょう。

- 人気の記事ランキング

-

- Namibia wants to build the world’s first hydrogen economy 砂漠の国・ナミビア、 世界初「水素立国」への夢

- Promotion MITTR Emerging Technology Nite #33 バイブコーディングって何だ? 7/30イベント開催のお知らせ

- Promotion Call for entries for Innovators Under 35 Japan 2025 「Innovators Under 35 Japan」2025年度候補者募集のお知らせ

- What comes next for AI copyright lawsuits? AI著作権訴訟でメタとアンソロピックが初勝利、今後の展開は?

- Why the US and Europe could lose the race for fusion energy 核融合でも中国が優位に、西側に残された3つの勝機

- Google’s electricity demand is skyrocketing グーグルの電力使用量が4年で倍増、核融合電力も調達へ

| タグ | |

|---|---|

| クレジット | Photograph by Alex Wong | Getty |

- アンドリュー・ローゼンブラム [Andrew Rosenblum]米国版 ゲスト寄稿者

- アンドリュー・ローゼンブラムは、MIT Technology Reviewのゲスト寄稿者で、ドローンや人工知能、セキュリティ、商用宇宙旅行についてポピュラー・サイエンス誌やワイヤード、フォーチュンなどにも寄稿しています。