人工知能(AI) 2020年12月の記事

-

-

Don’t underestimate the cheapfake

「ディープ」よりも厄介だった2020年の「チープ」フェイク問題 - 2020年は米大統領選挙におけるディープフェイクの氾濫が大きく懸念されていた。だが、この1年を振り返ると、むしろ問題になったのは、「チープフェイク」画像があらゆる場面で拡散され、メディアに対する人々の信頼を揺るがしたことだ。 by Nina Schick2020.12.31

-

Don’t underestimate the cheapfake

-

- AI研究者はそろそろ「見えない労働者」問題に向き合うべきだ

- 最近の人工知能(AI)の華々しい成果の背後には、米国の最低賃金にも満たない賃金で、機械学習モデルに入力するデータのラベル付けなどの作業を請け負うギグワーカーたちの存在がある。こうした「見えない労働者」の現状について、ウェストバージニア大学のサイフ・サベージ博士に話を聞いた。 by Will Douglas Heaven2020.12.24

-

- 他者を言葉で動かす方法を学習、目的達成手段として言語を使うAI

- ジョージア工科大学の研究者のチームは、自然言語処理と強化学習を組み合わせることにより、目的を達成するために言葉を使って他者に何かをさせるAIシステムを開発した。言語に満ちた私たちの世界がどのように成り立っているかを、より深く理解することにつながるかもしれない。 by Will Douglas Heaven2020.12.24

-

- 主張:AIはどのようにして人種差別を固定化するのか

- 人工知能(AI)アルゴリズムがバイアスを持つのは、アルゴリズムの訓練に使われる現実世界のデータセットに「白人至上主義」などの偏りが含まれているからだ。技術者や研究者は、使用するデータセットとアルゴリズムが反映する有害なイデオロギーに対し、責任を持たなければならない。 by Deborah Raji2020.12.23

-

- 4ビットで深層学習、IBMが「小さなAI」考案

- 最近の人工知能(AI)の研究で主流となっている大規模モデルの訓練では、膨大な計算機リソースや電力が必要となる。IBMは、AIモデルのパフォーマンスを大きく落とすことなく、4ビットでAIを訓練できる方法を発表した。 by Karen Hao2020.12.17

-

-

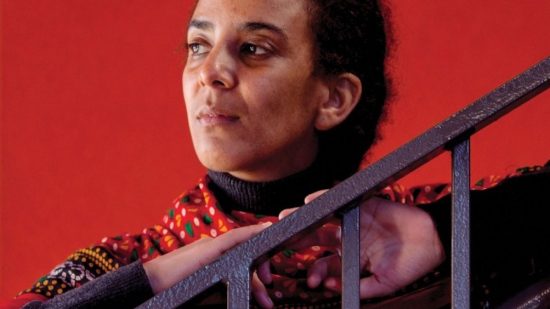

We read the paper that forced Timnit Gebru out of Google. Here's what it says

独自入手:グーグルが著名AI研究者を解雇した「問題論文」の中身 - グーグルのAI倫理チームの共同リーダーであったティムニット・ゲブルが解雇(グーグルは辞職と説明)されたことは関係者に衝撃を与えた。原因となった論文は、グーグルのビジネスの中核を支える大規模な言語モデルのリスクを指摘するものだった。 by Karen Hao2020.12.15

-

We read the paper that forced Timnit Gebru out of Google. Here's what it says

-

-

How the pandemic readied Alibaba’s AI for the world’s biggest shopping day

売上7.9兆円のアリババ「独身の日」を新型コロナはどう変えたか? - 新型コロナウイルス感染症のパンデミックはネットショッピングの行動にも大きな変化をもたらした。中国の電子商取引大手企業は、これまでのAIモデルでは予測不可能となった消費者の不規則な行動に対応するため、AIモデルの再構築を試みている。 by Karen Hao2020.12.3

-

How the pandemic readied Alibaba’s AI for the world’s biggest shopping day

-

-

This could lead to the next big breakthrough in common sense AI

「常識あるAI」へ新手法、言語+視覚でBERTしのぐ - テキストだけで訓練された人工知能(AI)には限界がある。ノースカロライナ大学チャペルヒル校の研究チームは、自然言語処理とコンピュータ-・ビジョンを組み合わせる新手法により、常識あるAIを実現しようとしている。 by Karen Hao2020.12.1

-

This could lead to the next big breakthrough in common sense AI

- アーカイブ

-

- 2025年6月

- 2025年5月

- 2025年4月

- 2025年3月

- 2025年2月

- 2025年1月

- 2024年12月

- 2024年11月

- 2024年10月

- 2024年9月

- 2024年8月

- 2024年7月

- 2024年6月

- 2024年5月

- 2024年4月

- 2024年3月

- 2024年2月

- 2024年1月

- 2023年12月

- 2023年11月

- 2023年10月

- 2023年9月

- 2023年8月

- 2023年7月

- 2023年6月

- 2023年5月

- 2023年4月

- 2023年3月

- 2023年2月

- 2023年1月

- 2022年12月

- 2022年11月

- 2022年10月

- 2022年9月

- 2022年8月

- 2022年7月

- 2022年5月

- 2022年4月

- 2022年3月

- 2022年2月

- 2022年1月

- 2021年12月

- 2021年11月

- 2021年10月

- 2021年9月

- 2021年8月

- 2021年7月

- 2021年6月

- 2021年5月

- 2021年4月

- 2021年3月

- 2021年2月

- 2021年1月

- 2020年12月

- 2020年11月

- 2020年10月

- 2020年9月

- 2020年8月

- 2020年7月

- 2020年6月

- 2020年5月

- 2020年4月

- 2020年3月

- 2020年2月

- 2020年1月

- 2019年12月

- 2019年11月

- 2019年10月

- 2019年9月

- 2019年8月

- 2019年7月

- 2019年6月

- 2019年5月

- 2018年11月

- 2018年10月

- 2017年10月