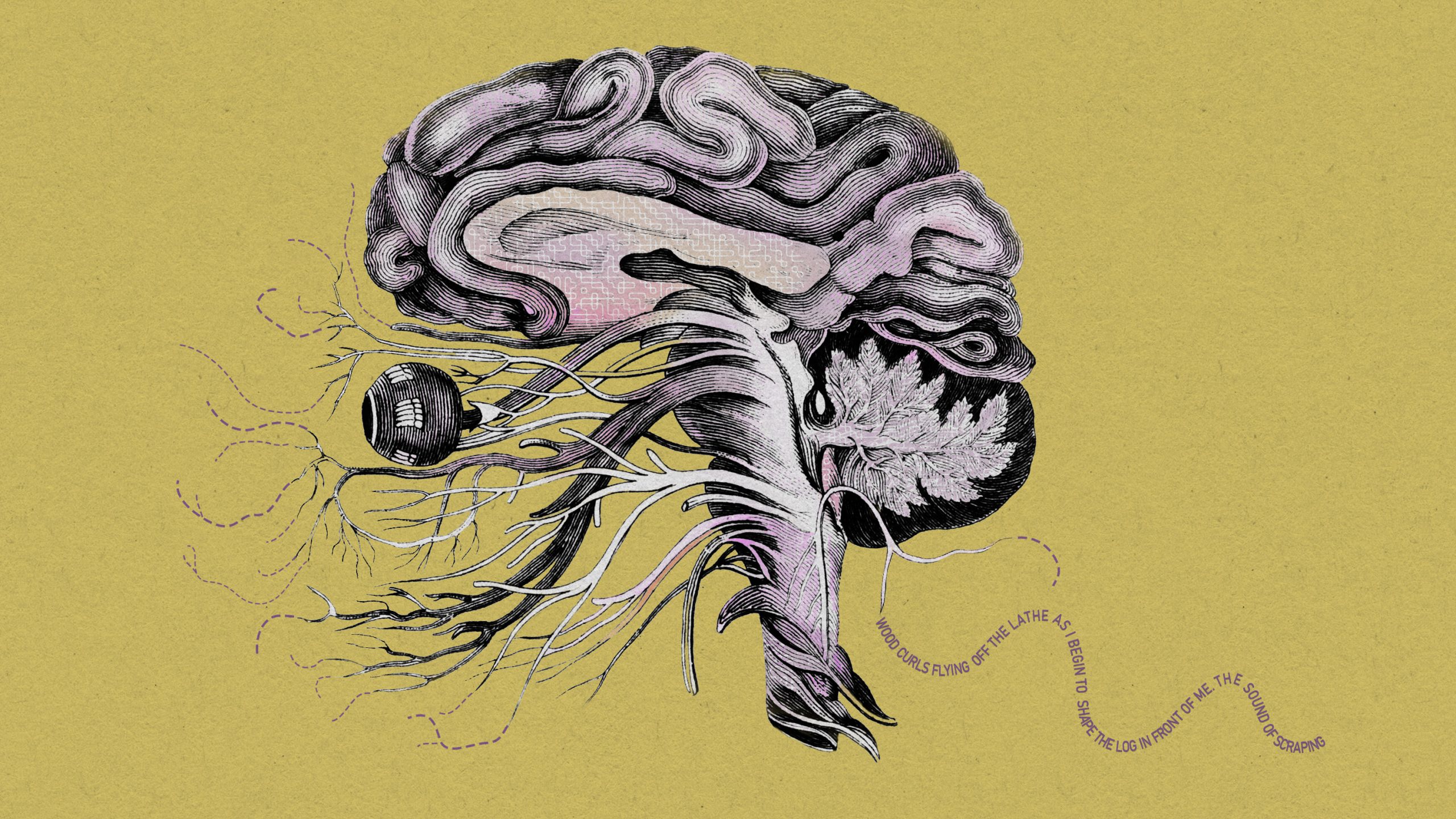

脳スキャンで話し言葉を解読、非侵襲型BCIでは初

テキサス大学の研究チームは、非侵襲性の脳コンピューター・インターフェイスを使って、考えていることを文章にする実験に成功した。同時に、脳の解読がもたらすプライバシーへの影響についての懸念を表明している。 by Rhiannon Williams2023.05.03

人の思考を言葉に変換できる非侵襲性の脳コンピューター・インターフェイス(BCI)は、いずれ脳卒中などの疾患や、筋萎縮性側索硬化症(ALS)を含むさまざまな病状によって発語能力を失った人々を助けられるかもしれない。

ネイチャー・ニューロサイエンス(Nature Neuroscience)誌に掲載された、テキサス大学オースティン校の研究によると、磁気共鳴機能画像法(functional magnetic resonance imaging:fMRI)を元に訓練されたモデルは、3人の被験者をfMRIでスキャンして脳活動を見るだけで、彼らが聞いている文章全体を驚異的な精度で予測できたという。この発見が意味するところは、我々の脳データをどのように保護するかの方針が将来必要になるということだ、と研究チームは述べている。

脳活動から話し言葉が解読されたことは過去にもあったが、そのためには通常、侵襲性の高い電極装置を人の脳内に埋め込む必要があった。その他の非侵襲性のシステムは、一語もしくは短いフレーズのみの解読に留まりがちだった。

今回のインターフェイスを製作したチームによれば、fMRIを通じて得られた非侵襲性の脳の記録から文章全体が解明されたのは、初だという。通常のMRI(磁気共鳴画像法)が脳構造の写真を撮る一方、fMRIスキャンは脳内の血の流れを計測し、ある活動によって脳のどの部分が活性化しているかを検知する。

研究チームはまず、オープンAI(OpenAI)が開発した大規模言語モデル「GPT-1」を、レディット(Reddit)、ザ・モス・ラジオアワー(Moth Radio Hour)の240個のストーリー、そしてニューヨーク・タイムズ紙の「モダン・ラブ(Modern Love)」ポッドキャストの書き起こしからの英文データセットを使って訓練した。

研究チームは、面白く、聞いて楽しい物語を使いたいと考えた。その方が、被験者が退屈してしまうようなコンテンツよりも良いfMRIデータが取れる見込みがあるからだ。

「私たちは皆ポッドキャストを聴くのが好きですから、MRIスキャンを受けながら聞かない手はないでしょう?」と冗談めかしていうのは、プロジェクトを主導したテキサス大学オースティン校のアレクサンダー・フース助教授(神経科学・コンピューター科学)だ。

研究の間、3人の被験者はそれぞれ同じポッドキャストの異なるエピソードを16時間、そしていくつかのTEDトークをMRIスキャンを受けながら聞いた。チームによると、ここでの目的は、言語関連のfMRI実験で通常使用される言語データセットの5倍以上という豊富なデータを収集することだった。

このモデルは、特定の言葉を読むことで引き起こされる脳の活動を予測する学習をした。解読は、単語の並びを予測し、それがどれだけ実際の単語に近いかをチェックする形で実行された。推測された単語に脳がどのように反応するかを予測し、それを実際に観測された脳の反応と比較したのだ。

新しいポッドキャストのエピソードでこのモデルを試行した際には、同モデルは被験者が聞いている話の要点を、脳の活動のみから解読することに成功しただけでなく、多くの場合において正確な単語やフレーズを特定することもできた。たとえば、被験者が「私はまだ免許証を持っていない」という言葉を聞いたときには、このモデルは「彼女はまだ運転の仕方を学び始めてもいない」という文章を出力した。

研究チームは、別の実験において、被験者に会話を含まないピクサーの短編動画を見せ、その際の脳の反応を記録した。この実験はこの解読モデルが、被験者が見ているものの大まかな内容を再現可能かどうかを調べるために考えられた。その結果、それが可能であることがわかった。

この実験には参加していないパリの視覚研究所(Vision Institute)の理論神経科学者であるロマン・ブレット博士は、また同技術の現段階での効果に完全に同意してはいない。「このアルゴリズムの仕組みは、基本的には脳スキャンから推測される文章の意味領域の曖昧な情報から、AIモデルが文章を作り上げるというものです」とブレット博士は言う。「大まかなレベルで、例えばどんな夢を見たかを推測するなど、面白い利用方法もあるでしょう。しかし、考えたり読んだりといったレベルにアプローチするという点においては、少々疑わしいです」。

今はまだ完璧には程遠いかもしれないが、この実験によって、将来的な監視や尋問といった用途での脳解読の使用可能性に関する倫理上の問題が明らかになった。このことを考慮し、研究チームは本人の協力なしに解読するようにモデルを訓練し、稼働させられるかのテストに着手した。テストはある人が聞いているスピーチを、別の人のデータによって訓練されたモデルを使って解読するという方法で実施された。その結果、ほぼうまくいかなかったという。

研究チームによれば、このことから分かるのは、解読モデルは、そもそも解読モデルの訓練に協力的でない人の脳の活動を解読することはできないということだという。

「我々は精神的プライバシーは非常に重要だと考えています。誰の脳も、本人の協力なしに解読されるべきではありません」と、プロジェクト参加者で同大学の博士課程生、ジェリー・タンは言う。「脳解読がもたらすプライバシーへの影響を研究し続けること、そして各人の精神的プライバシーを保護する法規制を定めることが重要だと考えています」。

- 人気の記事ランキング

-

- Will fusion power get cheap? Don’t count on it. 核融合は本当に安くなるのか? 楽観論に「待った」をかける新研究

- The problem with thinking you’re part Neanderthal あなたの中にいる 「ネアンデルタール人」は 本当に存在するのか?

- Is fake grass a bad idea? The AstroTurf wars are far from over. 「一番ましな悪い選択肢」 人工芝の安全性をめぐる 論争はまだ終わらない

- A new US phone network for Christians aims to block porn and gender-related content ポルノもLGBTも遮断、キリスト教徒向けMVNOが米国で登場

- リアノン・ウィリアムズ [Rhiannon Williams]米国版 ニュース担当記者

- 米国版ニュースレター「ザ・ダウンロード(The Download)」の執筆を担当。MITテクノロジーレビュー入社以前は、英国「i (アイ)」紙のテクノロジー特派員、テレグラフ紙のテクノロジー担当記者を務めた。2021年には英国ジャーナリズム賞の最終選考に残ったほか、専門家としてBBCにも定期的に出演している。