ある1人の生徒が映像の中で話している。「AIは赤ちゃんや人間の脳みたいなものなんだ。だってそれは学ぶ必要があるし」。生徒は続ける。「AIは、(中略)保存して、その情報を使って物事を把握するんだ」。

人工知能(AI)を友だちにざっくり説明するとしたら——? この複雑な問題をこれほど説得力のあるものにまとめようとすると、ほとんどの大人は四苦八苦してしまうだろう。だが、この映像に出てくる生徒はわずか10歳だ。

生徒はこの夏、MITメディアラボの試験的プログラムに参加した。AIについて教えるためのこのプログラムに参加したのは、9歳から14歳までの28名の中学生たち。プログラムのカリキュラムは、MITメディアラボの大学院生であるブレイクリー・ペイン研究助手が、AIの概念を中学校の教育に取り入れようとする広範な計画の一環として開発したものだ。

試験的プログラムの後、ペイン研究助手はカリキュラムをオープンソース化している。カリキュラムには、アルゴリズムがどのように開発され、そのプロセスが人々の生活にどのように影響を与えるのか? といったことを生徒が学ぶためのインタラクティブなアクティビティが含まれている。

現在の子どもたちは、AIに囲まれた世界で育っている。アルゴリズムがどの情報を見るかを決定し、見るべき動画を選択し、どのように会話すべきかを学ばせていく。望むらくは、アルゴリズムがどのように作られ、どのように社会に影響を及ぼすのかを子どもたちがよりよく理解することで、AIを賢く利用できるようになってほしい。そうなれば、子どもたちにテクノロジーの未来を創り出す意欲を持ってもらうことさえも可能かもしれない。

「子どもたちにテクノロジーがどのように働くのか理解してもらうことが大切です。テクノロジーをうまくコントロールして利用できるようになるためです。子どもたちに力を感じてほしいのです」とペイン研究助手は言う。

なぜ子どもたちなのか

子どもたちにAIについて学ばせる理由はいくつかある。まず、実利的な議論から見ていこう。研究の結果、子どもを技術的な概念に触れさせると、問題解決能力や批判的思考能力が刺激されることが明らかになっている。後になって、計算技能をずっと早く学べるように準備させることもできる。

次は、社会的な議論だ。中学生時代は特に、子どもたちの個性の形成と発達にとって大切な時期だ。この年頃の女の子にテクノロジーについて教えると、将来テクノロジーを研究したり、テクノロジーに関する仕事についたりする傾向が強くなる。こう説明するのは、カリフォルニア州立工科大学で心理学と子どもの発育学を研究するジェニファー・ジプソン教授だ。それにより、AI産業やテクノロジー産業全体の多様化が期待できる。また、早い時期にテクノロジーの倫理やその社会的影響について取り組んだ経験は、子どもたちがより意識の高いクリエイターや開発者、情報に通じた国民に成長するのを後押ししてくれるだろう。

そして最後に、脆弱さに関する議論がある。若者は柔軟性があり影響も受けやすい。そのため、他人の行動をまねして、そこから、中毒的行動に陥ってしまう倫理的危険性が高まる。こう語るのは、「学習者中心のデザイン(Learner Centered Design)」を専門とするユニバーシティ・カレッジ・ロンドンのローズ・ラッキン教授だ。子どもたちを受動的な消費者にしてしまっては、主体性やプライバシーに悪影響をおよぼし、長期的な成長も阻んでしまう可能性があるという。

「10歳から12歳というのは、子どもたちが初めて携帯電話を与えられたり、ソーシャルメディアのアカウントを持ったりする年齢です。その年頃の子どもたちに本当に理解して欲しいのは、そういったテクノロジーの中に必ずしも自分にあった意見や目的があるわけではないということです。テクノロジーにどっぷりはまり込んでしまう前にね」とペイン研究助手は話す。

意見としてのアルゴリズム

ペイン研究助手のカリキュラムには、生徒がアルゴリズムの主観性について考えるように促す一連のアクティビティがある。まずはアルゴリズムを、入力、一連の指示、出力などを備えたレシピとして学習することから始める。それから子どもたちは、最高のピーナッツバターとゼリーのサンドイッチを出力するアルゴリズムを「ビルド」する、つまり指示を書き出すよう求められる。

夏の試験的プログラムに参加した子どもたちは、プログラムに隠された教訓を即座に理解し始めた。「ある生徒は私を脇へと連れて行って、『これって意見だと思う? 事実だと思う?』と尋ねたんです」とペイン研究助手は言う。自分の力で発見する過程で、受講生たちは、意図せずに自分の好みをアルゴリズムに組み込んでいたことに気づいたのだ。

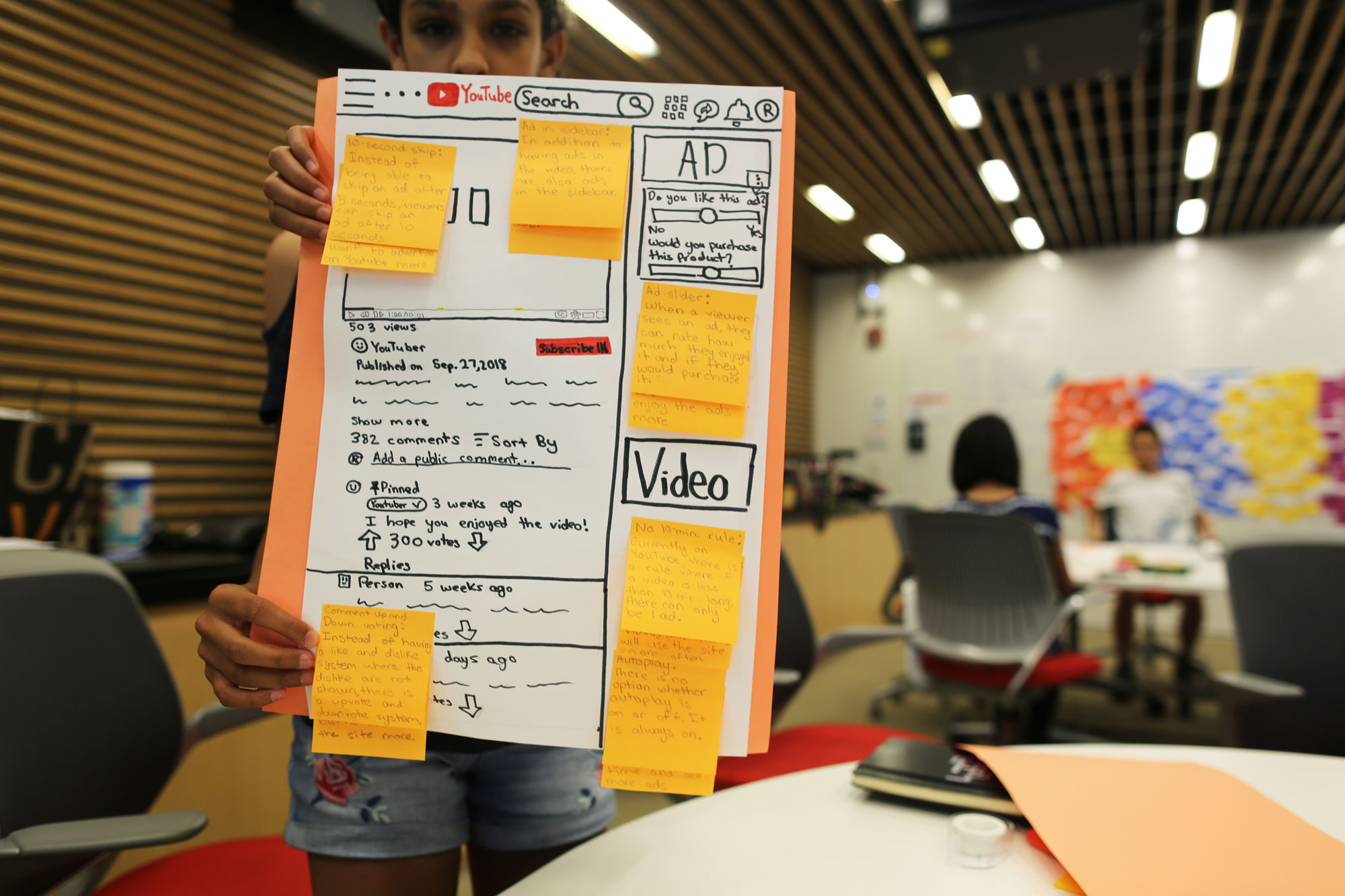

次の活動は、以下のようなコンセプトに基づいて作られている。ペイン研究助手が「倫理的マトリクス(Matrix)」と呼ぶものを受講生らが描いて、さまざまな利害関係者と彼らの価値観が、サンドイッチ・アルゴリズムの設計にどのように影響するかを考えるのだ。ペイン研究助手は試験的プログラムの各レッスンに、現在起こっている出来事を取り上げた。受講生はみんなで、ウォール・ストリート・ジャーナル紙の記事の要約版を読んだ。その記事はユーチューブの役員らが「おすすめ」アルゴリズムを変更して、子ども向けバージョンのアプリを別に作るべきかを検討しているという内容だ。受講生たちは、投資家の要求や、子を持つ親からの圧力、子どもの好みなどによって、企業がまったく違ったアルゴリズムを設計し直すことがあると学ぶことができた。

別のアクティビティでは、AIバイアスの概念について学ぶ。ここではグーグルの「ティーチャブル・マシン(Teachable Machine)」ツールを利用する。ティーチャブル・マシンは機械学習モデルを訓練するためのプログラミング不要のインタラクティブなプラットフォームで、これを使って猫と犬の分類機を作る。ただし、受講生には内緒で、偏ったデータセットを与えておく。受講生は、実験と議論を重ねるうち、データセットによって分類機が猫ばかりを正確に分類してしまうことに気づく。その後、受講生にその問題を修正する機会が与えられる。

ここでもペイン研究助手は、試験的プログラムにおけるこの練習を、現実の世界の例と関連づけた。MITメディアラボのジョイ・バオラムウィーニ研究員が、顔認識の偏りについて議会で証言する映像を受講生に見せたのだ。「現実世界において、どのような思考プロセスを経たかよって、システムの作られ方がどう変わってしまうのかを、子どもたちは理解してくれました」(ペイン研究助手)。

教育の未来

ペイン研究助手は、一般の意見を参考にしてプログラムを微調整していく計画だ。また、プログラムを広げるためのさまざまな手段を模索している。目標は、このプログラムを何らかの形で公教育に取り入れてもらうことだ。

さらにペイン研究助手は、このプログラムが、テクノロジーや社会、倫理などを子どもたちにどのように教えるかを示す1つの例になることも願っている。前出のラッキン教授やジプソン教授も、このプログラムが、ますますテクノロジー主導型になっていく世界の要求を満たすために、いかに教育が進化できるのかを示す有望なテンプレートを提供すると考えている。

「現在、私たちが世間で目にしているAIは、すべてを平等にする素晴らしいものではありません。教育は平等です。少なくともそうであって欲しいと望みます。ですから、これはもっと公平で公正な社会へと向かうために基礎となる第一歩なのです」(ペイン研究助手)。

- 人気の記事ランキング

-

- The balcony solar boom is coming to the US 安全性は大丈夫? 米国で「バルコニー発電」がブーム

- Three things in AI to watch, according to a Nobel-winning economist AIによる雇用破壊、ノーベル賞経済学者の答えはまだ「ノー」

- The era of AI malaise AI閉塞感の時代、私たちはまだ何も分かっていない

- Here’s what you need to know about the cruise ship hantavirus outbreak クルーズ船のハンタウイルス感染、パンデミックを心配すべきか?

- カーレン・ハオ [Karen Hao]米国版 寄稿者

- 受賞歴のあるフリー・ジャーナリスト。人工知能が社会に与える影響について取材している。ウォール・ストリート・ジャーナル紙の海外特派員として中国のテクノロジー業界を担当。2022年4月まではMITテクノロジーレビューのAI担当上級編集者を務めた。