この2年間で、深層学習の手法は人工知能の世界を変えてきた。ひとつずつ、人間が以前は自分たちに特有だと考えた能力や手法は、これまで以上に強力な機械の猛攻撃を受けている。今では、顔認識や物体認識などの処理では多層ニューラルネットワークは人間より優れている。多層ニューラルネットワークは、古来のゲームである碁をマスターし、最も優秀な名人を打ち負かした。

しかし、問題がある。なぜ層に並べられたネットワークは、この種の問題にこんなに強いのか、数学的理由が何もないのだ。数学者は困惑している。多層ニューラルネットワークの大成功にもかかわらず、多層ニューラルネットワークがどのように成功できたのか誰もよくわかっていないのだ。

9日、ハーバード大学のヘンリー・リン研究員とマサチューセッツ工科大学(MIT)のマックス・テグマーク教授の研究のおかげで、状況は変わった。2人によると、数学者が非常に困惑した理由は、その答えが宇宙の本質に関係しているからなのだ。言い換えると、その答えは、数学というよりむしろ物理の体系にある。

まず、100万ピクセルのグレースケール画像が、ネコなのかイヌなのか見極めて分類することを例に問題を紐解いていこう。

画像内には、それぞれ256段階のグレースケール値のどれかになる、100万ピクセルがある。したがって理論的には、2561000000種類の画像が存在し、それぞれの画像について、そこにネコがいるのかイヌがいるのかを判定する計算をする必要がある。

難しい問題だ。宇宙の原子の数よりずっと多くの画像があり得るのだ。だがニューラルネットワークは、何千あるいは何百万のパラメーターしかないのに、なぜか分類処理を難なくこなしてしまう。

数学の言語において、ニューラルネットワークは、より簡単な関数を伴う近似複素関数といえる。ネコとイヌの画像の分類についていえば、ニューラルネットワークは、100万のグレースケール・ピクセルを入力として取り入れ、それが何を表しているのかの確率分布を生み出す関数を実装しなければならない。

問題は、それらの近似値を求めるために、考え得るネットワークよりも桁違いに多くの数学的関数があることだ。にもかかわらず、多層ニューラルネットワークで、どういうわけか正しい答えが得られる。

ここでリン研究員とテグマーク教授は、なぜ可能なのかの答えを出したという。宇宙は、全ての考え得る関数の小さなサブセットによって支配されている、というのがその答えだ。つまり、物理法則が数学的に書かれる時、物理法則は、簡単な性質を持つ、ある公理系に属する関数によってすべて説明されるのだ。

だから多層ニューラルネットワークは、可能な限りのあらゆる数学的関数を概算する必要はなく、ただ関数の小さなサブセットを概算する必要があるだけなのだ。

これを視野に入れて問題を見直すために、最も高い指数のサイズである、多項式関数の桁を考える。つまり、y=x2のような二次方程式は、指数として2を持ち、方程式がy=x24なら指数24を持つ。

桁の数は無限大だが、物理法則に現れるのは多項式の小さなサブセットだけだ。「理由はまだ完全に理解されていませんが、私たちの宇宙は、低次の多項式ハミルトニアンによって正確に説明がつきます」とリン研究員とテグマーク教授はいう。一般的に、物理法則を説明する多項式の指数は、2から4の範囲に収まる。

物理法則には他にも重要な性質がある。たとえば、物理法則は、回転や並進に関して、通常対称である。360度ぐるりとネコやイヌを回すと同じに見える。10m、100m、1km平行移動させても、同じに見えるだろう。 それはまたネコやイヌの認識過程を概算するタスクを単純化する。

これらの性質は、ニューラルネットワークは、無限ともいえる、考えうる数学関数を概算する必要はなく、最も簡単な関数の小さなサブセットだけを概算する必要があることを意味する。

ニューラルネットワークが利用する宇宙の性質がもうひとつある。それはその構造の階層だ。「素粒子は、順番に分子、細胞、有機体、惑星、太陽系、銀河系などを形成する原子を形成します」とリン研究員とテグマーク教授はいう。複雑な構造でも、たいていは単純な構造の組み合わせで形作られる。

このような理由で、ニューラルネットワークの構造も重要だ。ニューラルネットワークの層では、因果関係におけるそれぞれの段階を概算できるのだ。

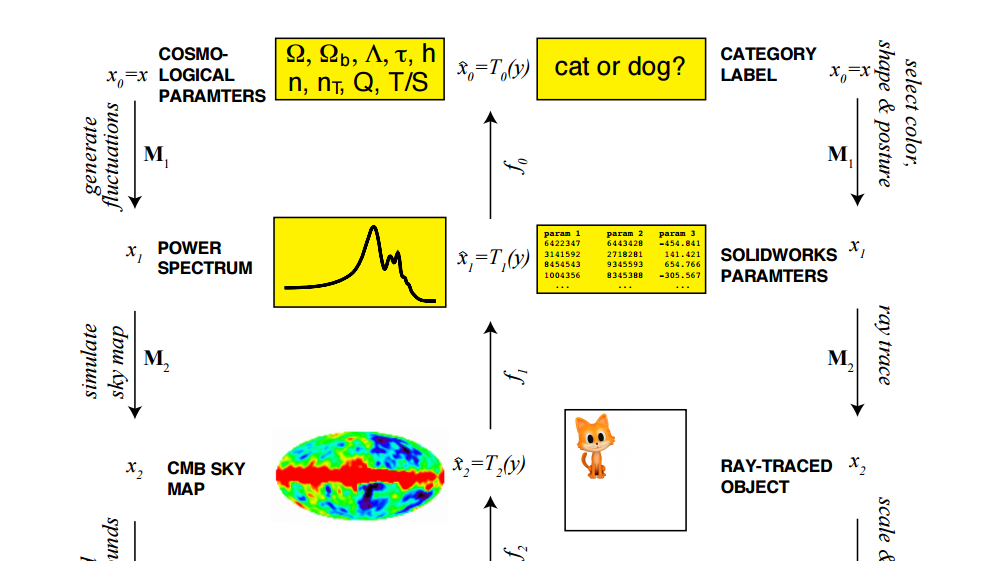

リン研究員とテグマーク教授は、宇宙に広がるビッグバンからのこだま、宇宙マイクロ波背景放射の例を挙げる。ここ数年、さまざまな宇宙船がこの放射線をこれまで以上に高い解析度で、宇宙空間の位置を特定している。そしてもちろん、物理学者たちは、なぜこれらの写像は、そのような形を成すのか頭をひねってきた。

リン研究員とテグマーク教授は、その理由が何であれ、疑いようもなく、それは、因果的階層の結果であると指摘する。

「一連の宇宙論パラメーター(暗黒物質密度など)は、私たちの宇宙における密度の変動のパワースペクトルを決定します。パワースペクトルは次に、初期宇宙から私たちのところに届く宇宙マイクロ波背景放射のパターンを決定します。そのパターンは、銀河系からの前景電波雑音と組み合わさって、衛星を利用した望遠鏡によって記録される周波数依存星図を作り出しています」

こうした因果的層のそれぞれは、漸進的にさらに多くのデータを含んでいる。ほんの一握りの宇宙論パラメーターしかないが、因果的層が含む星図や雑音は、何十億という数で構成されている。物理の目標は、さらに小さい数を明らかにするやり方で大きな数字を分析することだ。

そして現象がこの階層構造を持っている場合、ニューラルネットワークは、かなり容易くその分析を処理する。リン研究員とテグマーク教授は、「私たちは、深層(安直)学習(deep and cheap learning)の成功は、数学に依存するだけでなく、並外れて単純な確率分布の特定のクラスに有利に働く物理にも依存していることを示してきました。深層学習はモデルに比類なく適しています」と締めくくる。

重要な意義を持つ興味深くまた重要な研究だ。人工ニューラルネットワーク は周知の通り、生物学的ネットワークに基づいている。だからリン研究員とテグマーク教授の考えによって、なぜ深層学習機械が非常にうまく機能するのかについて説明がつくだけでなく、2人の考えによって、なぜ人間の脳は宇宙を理解できるのかについても説明がつく。進化は、どういうわけか、理想的に宇宙の複雑さと区別して脳構造を決めてきた。

この研究は、人工知能における著しい進歩に向けた道を開く。今や、私たちはようやくなぜ多層ニューラルネットワークは非常によく機能するのか理解したのだから、数学者は、多層ニューラルネットワークがうまく実行できる特定の数学的性質を研究する取り組みを始められる。「深層学習の解析的理解を強めることによって、深層学習を向上させる方法が示唆されるかもしれません」とリン研究員とテグマーク教授はいう。

深層学習は、ここ数年、大きく変わった。こうした理解の改善があったので、進歩の速度が、加速するのは必至だ。

参照:arxiv.org/abs/1608.08225: なぜ深層(安直)学習(deep and cheap learning)は非常にうまくいくのか?

- 人気の記事ランキング

-

- The balcony solar boom is coming to the US 安全性は大丈夫? 米国で「バルコニー発電」がブーム

- Three things in AI to watch, according to a Nobel-winning economist AIによる雇用破壊、ノーベル賞経済学者の答えはまだ「ノー」

- The era of AI malaise AI閉塞感の時代、私たちはまだ何も分かっていない

- Here’s what you need to know about the cruise ship hantavirus outbreak クルーズ船のハンタウイルス感染、パンデミックを心配すべきか?

- エマージングテクノロジー フロム アーカイブ [Emerging Technology from the arXiv]米国版 寄稿者

- Emerging Technology from the arXivは、最新の研究成果とPhysics arXivプリプリントサーバーに掲載されるテクノロジーを取り上げるコーネル大学図書館のサービスです。Physics arXiv Blogの一部として提供されています。 メールアドレス:KentuckyFC@arxivblog.com RSSフィード:Physics arXiv Blog RSS Feed