人工知能(AI)

-

オープンAI、ロビー活動費を7倍に 新政権で政治関与を強化

-

オープンAIもAIエージェント、ブラウザー操作を代行

オープンAI(OpenAI)は、Webブラウザー上の操作を自動的に実行するエージェント「オペレーター(Operator)」をリリースした。簡単な指示でネット上での注文などの操作を代行する。

-

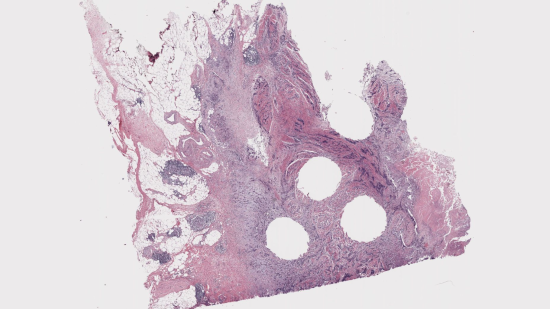

期待されたAI画像診断、臨床導入に残された技術的課題は?

AIによる病理画像の分析は15年前から期待されてきた有望分野だ。人間を超える精度を弾き出すこともあるが、臨床での実用化には訓練データの不足、巨大画像の処理など、解決すべき技術的課題が残っている。

-

ちょっとニッチな2025年のAI業界の予測

2025年にはAI業界で何が起こるか。AIエージェントや小規模言語モデルといった明らかな予測以外には、温暖化ガス排出量の急増、軍事産業への寄与、中国とのチップ戦争などに注目したい。

-

メタ、音声から直接翻訳するAIモデル リアタイ通訳実現近づく

メタが、101種類の言語の音声を別の言語の音声へと翻訳できるAIモデルを発表した。SF小説で描かれてきたような、言語間のリアルタイム同時通訳の実現が近づいている。

-

「ググる」時代の終わり、 世界の知識を解き放つ 生成AI検索がもたらすもの

-

楽観?悲観? 「世界を変える10大技術」から考えるAIの未来

-

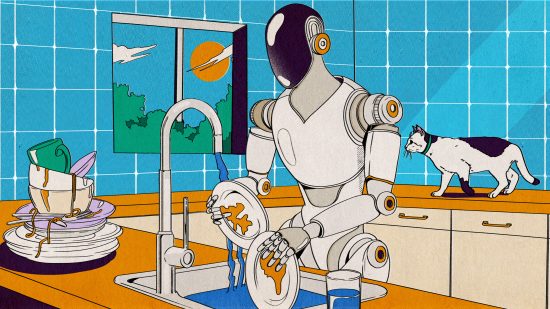

高速学習ロボット:世界を変える10大技術

生成AIの進歩は、ロボットの訓練プロセスを大幅に加速した。先行して導入が進む倉庫ロボットで得られた成果はいずれ、家庭用スマート・ロボットの土台となるかもしれない。

-

ロボタクシー:世界を変える10大技術

アプリで呼び出せる無人タクシーは、世界中の10以上の都市に広がっている。今後、ますます多くの人々がロボタクシーを初めて体験するようになるだろう。

-

小規模言語モデル:世界を変える10大技術

-

生成AI検索:世界を変える10大技術

グーグルの検索結果に表示される「AIによる概要」をはじめとする生成AI検索は、従来の検索エンジンの概念を覆す一方で、スマートフォンですばやく情報を見つける助けとなるだろう。

-

「外部知識で進化する言語モデル、より信頼できるAIへ」浅井明里

MITテクノロジーレビュー「Innovators Under 35 Japan Summit 2024」から、ワシントン大学所属の浅井明里氏のプレゼンテーションの内容を要約して紹介する。

-

アンソロピック主任科学者が語る「AIエージェント」4つの進化

-

2025年のAIはこう動く 本誌が予測する5大トレンド

-

「深層予測学習でロボットとAIのギャップを埋める」伊藤 洋

MITテクノロジーレビュー「Innovators Under 35 Japan Summit 2024」から、日立製作所/早稲田大学所属の伊藤 洋氏のプレゼンテーションの内容を要約して紹介する。

-

仲田真輝:人工生命起業家が「魚の養殖」にピボットした理由

-

「7つの失敗」で振り返る 2024年のAIシーン

-

家事ロボット、実は8割は遠隔操作 あなたは受け入れられますか?

-

元ピクサーのアニメーターと オープンAI技術者が目指す 「信頼される」執事ロボット

-

消費電力「数十万分の一」、ハード実装の次世代ニューラルネット

-

動画はほぼユーチューブ、 大規模調査で分かった AI訓練データの一極集中

-

生成AIの隠れた代償、激増するデータセンターの環境負荷

人工知能(AI)の急速な進化に伴って、ますます膨大な電力が必要になっている。AI企業は持続可能性目標の達成と、大量の電力を必要とする大規模モデルの開発との板挟みになっている。

-

渡り鳥の声を聞き分ける—— 機械学習ツールが導く 生物音響学研究の新時代

-

AIブームで特需、 米国内のデータセンター CO2排出量が3倍に

米国のデータセンターの二酸化炭素排出量は2018年以降、3倍に増加している。オープンAIの「Sora(ソラ)」のような、より複雑なAIモデルが普及すれば、この数字はさらに上昇するだろう。

-

AI企業の誇大広告に「待った」、米FTCが政権交代前の大仕事

米国連邦取引委員会(FTC)がAI企業による誇大宣伝や虚偽表示を追求している。カーン委員長の任期終了が迫る中、次々と措置を講じ、業界の放漫な主張に歯止めをかけようとしている。