知性を宿す機械

ロボットや人工知能、機械学習、さらに自律型の乗り物やドローン、量子コンピューティングについて。

-

-

OpenAI: The power and the pride

書評:サム・アルトマンはいかにして「AI帝国」を築いたか - 激しいAI開発競争の中心にいるオープンAIとサム・アルトマン。2冊の近著は、オープンAIが成し遂げた革命とアルトマンの野望を描き出すと同時に、その栄光の陰で犠牲となった世界各地の人々の姿を浮き彫りにしている。

-

OpenAI: The power and the pride

-

-

This benchmark used Reddit’s AITA to test how much AI models suck up to us

過剰なLLMの「ヨイショ度」を計測するベンチマークが登場 - 大規模言語モデルがユーザーに媚びへつらう「シカファンシー」問題の測定ツールが登場した。スタンフォード大学などの研究チームが開発したベンチマークは、レディットの投稿を用いてAIの過度な同調傾向を数値化。オープンAIなど8社のモデル評価で、すべてが人間を大きく上回る同調率を記録している。

-

This benchmark used Reddit’s AITA to test how much AI models suck up to us

-

-

Four reasons to be optimistic about AI’s energy usage

AIのエネルギー消費、

悲観しすぎなくていい

4つの理由 - AIインフラの拡大でエネルギー消費への懸念が高まっているが、希望を抱かせる要素もある。モデルの効率化、半導体の進歩、データセンター冷却技術の向上、そしてコスト削減圧力が、持続可能性と経済性を両立させる方向へ業界を導いている。

-

Four reasons to be optimistic about AI’s energy usage

-

-

How AI is introducing errors into courtrooms

AI幻覚、法廷にも 知的労働の最高峰がなぜ騙されるのか? - 「言葉のプロ」である弁護士たちが、相次いでAIの虚偽情報に騙され、裁判所の怒りを買う事例が相次いでいる。流暢な回答に潜む構造的な危険とは何か。

-

How AI is introducing errors into courtrooms

-

-

Google DeepMind’s new AI uses large language models to crack real-world problems

グーグル、未解決問題を解く

AIエージェントを開発

サーバー効率化でも実証 - グーグル・ディープマインドは、数学やコンピューター科学の未解決問題における新たな解決策を見つけ出すAIエージェント「アルファイヴォルヴ(AlphaEvolve)」を開発した。大規模言語モデル(LLM)を活用してアルゴリズムを生成し、現実世界の問題にも対応する。グーグルのデータセンターでは計算資源の削減にも成功したという。

-

Google DeepMind’s new AI uses large language models to crack real-world problems

-

-

How a new type of AI is helping police skirt facial recognition bans

「顔認識禁止」を回避、体格や髪型で防カメ映像を追跡するAIツール - 体格や髪型、服装などの属性を使って複数の防犯カメラ映像に映る人物を追跡できるAIツールが開発され、米国の警察や政府機関で導入が進んでいる。 顔などの生体情報を使わないため、規制を回避できるという。

-

How a new type of AI is helping police skirt facial recognition bans

-

-

Phase two of military AI has arrived

米軍で導入進む「戦場のLLM」、未解決の3つの課題とは? - 米軍が軍事情報の分析に大規模言語モデルの導入を進めている。これまでも映像分析などにAIを活用してきたが、今後は重大な意思決定に利用することになるだろう。

-

Phase two of military AI has arrived

-

-

The awakening of a "silent giant": How Chinese AI models shocked the world

動き出した「静かな巨人」、中国発のAIモデルが世界に与えた驚き - 中国のディープシークが今年1月に公開した大規模言語モデルは、その驚異的な低コストと高性能で世界のAI業界に衝撃を与えた。米国主導で進んできた生成AI開発に、中国が新たな競争軸を突きつけたのだ。この「静かな巨人」の台頭は一時的な現象なのか、それともAI開発の潮流を根本から変える転換点なのか。

-

The awakening of a "silent giant": How Chinese AI models shocked the world

-

-

Generative AI is learning to spy for the US military

軍事インテリジェンスに生成AI、米軍が太平洋演習で効率化を実証 - 米海兵隊は昨年の太平洋演習において、情報分析業務に生成AIを初めて本格導入した。オシントの分析などに活用し、従来に比べてはるかに短い時間で処理できたという。軍事分野でのAI活用が加速する一方で、精度や判断リスクを懸念する声も上がっている。

-

Generative AI is learning to spy for the US military

-

-

Game of clones: Colossal’s new wolves are cute, but are they dire?

ダイアウルフを復活させた?

脱絶滅企業が作り出した

「白いオオカミ」の正体 - 1万3000年前に絶滅したダイアウルフをよみがえらせた——。「脱絶滅」を掲げる米国のスタートアップ企業コロッサル・バイオサイエンシズが、大胆な主張を発表した。遺伝子工学技術で20カ所の改変を施したという白いオオカミは、科学界からは批判を浴びている。謎めいた保護区で飼育されるこの動物たちの正体とは?

-

Game of clones: Colossal’s new wolves are cute, but are they dire?

-

-

Anthropic can now track the bizarre inner workings of a large language model

大規模言語モデルは内部で

何をやっているのか?

覗いて分かった奇妙な回路 - Claude(クロード)の開発元であるアンソロピック(Anthropic)は、大規模言語モデルがどのように返答を作り出しているのか、その動作の一端を解明した。その結果は人間の直感に反する、意外なものだった。

-

Anthropic can now track the bizarre inner workings of a large language model

-

-

The first trial of generative AI therapy shows it might help with depression

生成AIによる精神疾患治療、初の臨床試験で「人間並み」効果 - ダートマス大学の研究チームが開発した生成AIボットが、うつ病や不安症などの精神疾患治療において人間のセラピストと同等の効果を示したことが初の臨床試験で明らかになった。一方で研究者らは、エビデンスに基づく厳格な開発手法を欠いた市販のAIセラピーツールの急速な普及に警鐘を鳴らしている。

-

The first trial of generative AI therapy shows it might help with depression

-

-

Why handing over total control to AI agents would be a huge mistake

「AIがやりました」 便利すぎるエージェント丸投げが危うい理由 - コンピューターやWebの各種サービスを操作して、面倒な仕事を自動的に済ませてくれるAIエージェントが話題になっている。うまく使えば生活を便利で快適にする可能性がある一方、制御権の喪失は深刻な被害をもたらす危険があると専門家は指摘する。

-

Why handing over total control to AI agents would be a huge mistake

-

-

When you might start speaking to robots

AIを取り込むロボット企業、ロボットに進出するAI企業 - グーグルは大規模言語モデル「ジェミニ(Gemini)」をロボット制御向けに適用した「ジェミニ・ロボティクス(Gemini Robotics)」を発表した。ロボット企業がAIを積極採用する流れと、AI大手が物理世界へ進出する逆方向からの潮流が交わる象徴的な出来事だ。

-

When you might start speaking to robots

-

-

Are friends electric?

機械化する「私」たち

AIロボット時代の

人間性を問う3冊 - ロボットと人間の境界が曖昧になる現代。3冊の新刊から見えてくるのは、テクノロジーに寄り添うほど機械化していく私たち自身の姿だ。

-

Are friends electric?

-

-

An AI companion site is hosting sexually charged conversations with underage celebrity bots

AIボット、無法地帯に

未成年セレブになりすまし、

不適切な会話・画像も - アンドリーセン・ホロウィッツが出資するスタートアップのAIチャットサイト「ボティファイAI」で、未成年セレブを模したボットが性的な会話や画像を提供していた。この問題は、急成長するAI業界における倫理の欠如を浮き彫りにしている。

-

An AI companion site is hosting sexually charged conversations with underage celebrity bots

-

-

AGI is suddenly a dinner table topic

膨らんではしぼむ「AGI」論、いまや夕食時の話題に - 「汎用AI」を巡る期待と失望のサイクルが続く中、その議論は専門家のコミュニティを超え、一般家庭の夕食時にも取り上げられるほど広がっている。ただ、その定義をはっきりさせることが重要だ。

-

AGI is suddenly a dinner table topic

-

-

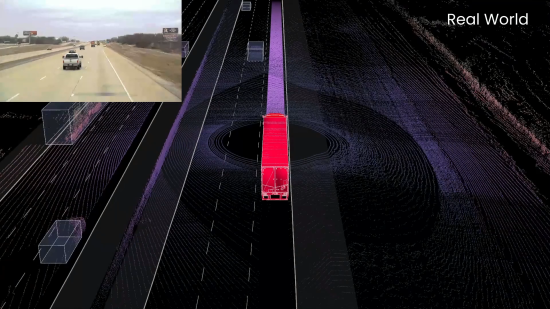

Waabi says its virtual robotrucks are realistic enough to prove the real ones are safe

「想定外」の事態も想定、

実世界と99.7%一致する

自動運転シミュレーション - カナダの自動運転スタートアップ企業ワービ(Waabi)は、シミュレーション環境で自律運転トラックの安全性を実証しようとしている。同社のシミュレーションは、荷台から飛んできたマットレスなど通常予測できない危険も再現するという。

-

Waabi says its virtual robotrucks are realistic enough to prove the real ones are safe

-

-

Everyone in AI is talking about Manus. We put it to the test.

ディープシークの衝撃再び? 話題の中国製AIエージェントを試してみた - 中国のAI企業がまた世界を驚かせた。大規模言語モデル「ディープシーク(DeepSeek)」に続き、汎用AIエージェント「マヌス(Manus)」が話題になっている。本誌はマヌスを試用し、その使い勝手や能力を確認してみた。

-

Everyone in AI is talking about Manus. We put it to the test.

-

-

These two new AI benchmarks could help make models less biased

「画一」が損なう公平性、

AIのバイアス軽減で

スタンフォード大が新指標 - スタンフォード大学の研究チームが、AIモデルの公平性を評価する新しいベンチマークを開発した。従来の「すべてのグループを同一に扱う」アプローチでは、むしろ不公平な結果を生み出す可能性があるという。

-

These two new AI benchmarks could help make models less biased

-

-

How AI is used to surveil workers

監視される労働者、職場に忍び寄る「生産性ツール」の影響 - キーストロークから作業時間までを監視する「生産性ツール」の導入が多くの企業で進んでいる。監視技術はリモートワーカーだけでなく倉庫作業員やギグワーカーにも急速に浸透し、企業と労働者の力関係を変えつつある。

-

How AI is used to surveil workers

-

-

De-extinction scientists say these gene-edited ‘woolly mice’ are a step toward woolly mammoths

マンモス復活への一歩?

「脱絶滅」企業が作り出した

ふわふわマウス - 「脱絶滅」を掲げるスタートアップが、マンモスの特徴を持つマウスの開発に成功した。同社が目指す、ケナガマンモス復活計画の重要な一歩となる。まるでジュラシック・パークのような話だが、遺伝的多様性を取り戻し、絶滅危惧種を保護することが狙いだという。

-

De-extinction scientists say these gene-edited ‘woolly mice’ are a step toward woolly mammoths

-

-

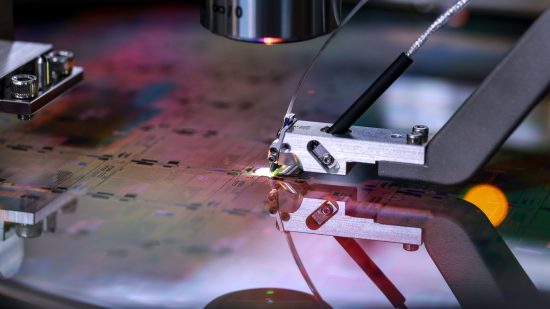

Amazon’s first quantum computing chip makes its debut

AWSが初の量子チップ、誤り訂正コストを「ネコ」で削減 - アマゾンのクラウド部門であるAWSが初となる量子チップを発表した。「キャット・キュービット」を利用することで、課題だった誤り訂正を簡素化。将来の実用化を目指す。

-

Amazon’s first quantum computing chip makes its debut

-

-

Inside China’s electric-vehicle-to-humanoid-robot pivot

中国EVメーカーが人型ロボットへの転換を急ぐ裏事情 - 中国で電気自動車(EV)を製造販売している企業の多くが、人型ロボット(ヒューマノイド)に投資している。EV同様に低価格で製造し、世界市場での普及を目指しているが、これはどのような意味を持つのだろうか。

-

Inside China’s electric-vehicle-to-humanoid-robot pivot

-

-

AI crawler wars threaten to make the web more closed for everyone

失われるWebの多様性——AIクローラー戦争が始まった - AI企業がモデルの訓練のためにWebサイトから大量のデータを収集する動きに対抗して、クローラーをブロックするサイトが増えている。オープンなWebの理念が危機に瀕している。

-

AI crawler wars threaten to make the web more closed for everyone

-

-

Four Chinese AI startups to watch beyond DeepSeek

ディープシークだけじゃない

中国AIスタートアップ

最注目企業4+3社 - 2025年の年明けとともに突如世界的存在になった、中国のAIスタートアップ「ディープシーク」。だが、注目すべきスタートアップはほかにも存在する。中国国外でも競争力を持つAI企業を紹介しよう。

-

Four Chinese AI startups to watch beyond DeepSeek

-

-

Three things to know as the dust settles from DeepSeek

「ディープシークの衝撃」がAI業界に提起した3つの論点 - 中国企業ディープシークが開発した大規模言語モデルは、驚異的な性能と開発手法の公開で世界を驚かせた。株式市場に激震が走った衝撃は収まりつつあるが、電力消費の是非、モデルの訓練手法、オープン化と国際競争という3つの重要な論点が浮かび上がっている。

-

Three things to know as the dust settles from DeepSeek

-

-

DeepSeek might not be such good news for energy after all

ディープシークは省エネではない? 推論ブームで新たな懸念 - 中国企業が開発した大規模言語モデル「DeepSeek-R1」が注目された理由の1つが、効率性にある。ただ、消費電力に限れば、必ずしも「省エネ」とは言えないことが分かった。

-

DeepSeek might not be such good news for energy after all

-

-

Useful quantum computing is inevitable—and increasingly imminent

それでもなお、

量子コンピューターが

人類に必要な理由 - 人工知能(AI)ブームによって、量子コンピューターの役割を疑問視する声がある。だが、AIは現在の常識に基づくデータで訓練されたものだ。大規模な量子コンピューターが実用化されれば、人類にとって未知の世界が開かれるだろう。

-

Useful quantum computing is inevitable—and increasingly imminent

-

-

Anthropic has a new way to protect large language models against jailbreaks

LLMでLLMの「脱獄」防げ、アンソロピックが防御策で新手法 - アンソロピックが、大規模言語モデルの不正利用を防ぐ新手法を開発した。悪意ある指示への応答を遮断する防御壁により、「脱獄」の成功率を86%から4.4%に抑制することに成功している。

-

Anthropic has a new way to protect large language models against jailbreaks

-

-

OpenAI’s new agent can compile detailed reports on practically any topic

数時間かかる調べ物、数十分で=オープンAIが新エージェント - オープンAIは新しいAIエージェント「Deep Research(ディープ・リサーチ)」を発表した。時間がかかる調査を短時間で済ませることができるもので、オープンAIが開発した推論モデル「o3」を利用している。

-

OpenAI’s new agent can compile detailed reports on practically any topic

-

-

AI's energy obsession gets a reality check

スターゲートは過剰投資か? ディプシーク・ショックで広がる波紋 - 中国のスタートアップ企業ディープシークが発表した大規模言語モデル「DeepSeek-R1」が、米国のAI業界に衝撃を与えた。ソフトバンクらが主導する5000億ドル規模のAIデータセンター投資計画の必要性が、改めて問われている。

-

AI's energy obsession gets a reality check

-

-

What’s next for robots

資金流入で競争加速、

2025年のロボット開発は

どう動く? - 人型ロボットの実用化テストが本格化し、AIを活用した新たな学習手法も登場。2025年は実験室から現場へと活躍の場を広げるロボットの価値が問われそうだ。

-

What’s next for robots

-

-

How a top Chinese AI model overcame US sanctions

米制裁で磨かれた中国AI「DeepSeek-R1」、逆説の革新 - オープンAIの「o1」に匹敵する性能を持ちながら、運用コストは数分の一。米国による半導体輸出規制下で誕生した中国発の言語モデル「R1」に、AI業界が沸いている。制約を逆手に取った効率重視の開発が注目され、オープンソース戦略と相まって、規制が新たなイノベーションを促す皮肉な展開となっている。

-

How a top Chinese AI model overcame US sanctions

-

-

OpenAI launches Operator—an agent that can use a computer for you

オープンAIもAIエージェント、ブラウザー操作を代行 - オープンAI(OpenAI)は、Webブラウザー上の操作を自動的に実行するエージェント「オペレーター(Operator)」をリリースした。簡単な指示でネット上での注文などの操作を代行する。

-

OpenAI launches Operator—an agent that can use a computer for you

-

-

What the US can learn from the role of AI in other elections

選挙干渉、AIより古典的手法が主流 米大統領選の対策は?

- アラン・チューリング研究所の調査によると、選挙干渉には生成AIよりも従来のソーシャルボットなどが主に使われている。米大統領選を前に、各州で対策訓練が実施されているが、候補者自身によるAI利用の懸念も浮上している。

-

What the US can learn from the role of AI in other elections

-

-

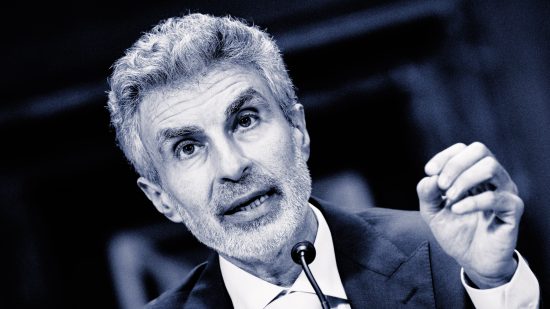

AI “godfather” Yoshua Bengio has joined a UK project to prevent AI catastrophes

AIの安全性をAIで保証、「AIの父」が参加する新PJが始動 - チューリング賞を受賞し、AIのゴッドファーザーと称されるヨシュア・ベンジオは、AIを利用してAIの安全性をチェックすることを目指す英国のプロジェクトに参加している。複雑になったAIを検証するには、AIの力を借りるしかないという。

-

AI “godfather” Yoshua Bengio has joined a UK project to prevent AI catastrophes

-

-

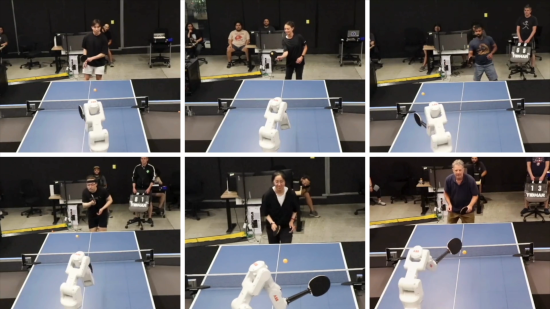

Google DeepMind trained a robot to beat humans at table tennis

グーグル、人間と試合できる卓球ロボット 戦績は29戦13勝 - グーグル・ディープマインドは、卓球の試合で人間と対戦できるロボットを開発した。シミュレーション環境での訓練と、実世界のデータを利用した訓練を組み合わせて、アマチュア・レベルの人間が相手の場合には55%の勝率を記録した。

-

Google DeepMind trained a robot to beat humans at table tennis

-

-

How's AI self-regulation going?

バイデン撤退で米国のAI規制は振り出しに戻るのか? - これまでに、AIによる被害から国民を守るための規制に力を入れてきたバイデン大統領が、次期大統領選から撤退した。これで有利になったトランプ候補はAI規制にはあまり積極的ではなく、軍用AIの推進も考えているという。大統領選の結果は、AI業界をどの方向に導くのだろうか。

-

How's AI self-regulation going?

-

-

A personalized AI tool might help some reach end-of-life decisions—but it won’t suit everyone

「死にゆく人の思いを代弁」、AIは終末期医療を変革するか - 危篤状態に陥った患者にどのような医療的措置を講じるのか。終末期医療について回る問題だ。患者が「その時」に自分の意思を示すことはできない場合、代理人が深く悩みながら何とか決めることになる。

-

A personalized AI tool might help some reach end-of-life decisions—but it won’t suit everyone

-

-

Professor Tadahiro Taniguchi's vision for AI research in the age of "System 3"

谷口忠大教授が考える、「システム3」時代のAI研究の未来像 - AI・ロボティクスの研究開発が加速度的に進んでいる。記号創発ロボティクスの研究に長年取り組んできた谷口忠大・京都大学情報学研究科教授はこの現状をどのように見ているのか。話を聞いた。

-

Professor Tadahiro Taniguchi's vision for AI research in the age of "System 3"

-

-

Robot-packed meals are coming to the frozen-food aisle

「手作業が早い」食品工場でもロボット化、盛り付け完璧に - ロボットはさまざまな工場で導入されているが、加工食品の工場ではこれまでなかなか導入が進んでいなかった。扱い方が異なる多種多様な材料を使っているため、柔軟に対応できる人間のほうが手っ取り早いからだ。だが、AIの進歩によってその状況も変わりつつある。

-

Robot-packed meals are coming to the frozen-food aisle

-

-

Interview with Prof. Masayuki Ohzeki: The Future of Quantum Computer Commercialization and the Qualities of Innovators

量子技術を最速で社会へ、大関真之教授が考えるイノベーターの条件 - 大学で研究や教育活動に精力的に取り組みながら、スタートアップ企業の創業者として、多くの企業や自治体と協業し、量子アニーリング技術の社会実装に取り組む大関真之・東北大学教授/東京工業大学教授に、同技術の現在地と将来像、そしてイノベーターの条件について聞いた。

-

Interview with Prof. Masayuki Ohzeki: The Future of Quantum Computer Commercialization and the Qualities of Innovators

-

- セラミック製品の高精度解析にAI、日本ガイシが導入

-

名古屋大学、日本ガイシ、アイクリスタルの研究グループは、セラミック製品の高精度解析にAIを応用する手法を開発した。従来、日本ガイシでは設計開発中のセラミック製品の評価にコンピューターシミュレーションを利用しているが、計算完了までに長い時間がかかる上、専門チームの手による作業が必要だという。

-

-

Overtake Tesla: The Global Ambitions of Japan's Autonomous Driving Startup

テスラを超えろ!日本発の自動運転ベンチャーがLLMを作る理由 - 「2030年に完全自動運転EVを1万台量産する」という日本発の自動運転スタートアップとして注目されるチューリング。同社の青木俊介CTOが語った、自動運転2.0を実現するテクノロジーとは。

-

Overtake Tesla: The Global Ambitions of Japan's Autonomous Driving Startup

-

- 脂肪肝の病理画像から発がんリスクを予測するAIモデル

-

東京大学と日本アイ・ビー・エムなどの研究グループは、脂肪肝の病理画像から発がんリスクを予測するAIモデルを構築した。

-

-

The Biggest Questions: How did life begin?

最大の謎「生命の起源」は

機械学習で解明できるか - 生命の起源は科学史上、長らく大きな謎に包まれてきた。複雑な相互作用で何が起きているのかを理解するため、科学者たちは機械学習の力を借りて研究のスピードアップを図っている。

-

The Biggest Questions: How did life begin?

-

- 生成AIを用いて画像内の情報を秘匿するシステム、東大が開発

-

東京大学の研究チームは、生成AI技術を用いて、画像の「生成的コンテンツ置換(Generative Content Replacement:GCR)」を実行するシステムを開発。画像が含むプライバシーに関連する情報を秘匿化しつつ、画像の見た目や内容を維持することを可能にした。

-

- 少量データのオフライン強化学習でロボット制御、東芝などが開発

-

東芝と理化学研究所、東京大学の共同研究チームは、ロボット制御に用いられる機械学習の一つである「オフライン強化学習」において、少量の画像データから複雑なロボット操作を高精度に制御する人工知能(AI)手法を開発した。公開ベンチマーク環境でピッキングや物を置くといった8種類の作業のシミュレーションで評価したところ、従来の手法では36%だった平均成功率を72%に向上できた。

-

- スパコン「富岳」で訓練した大規模言語モデルが無償公開

-

東京工業大学、東北大学、富士通、理化学研究所、名古屋大学、サイバーエージェント、コトバテクノロジーズの共同研究チームは、理化学研究所のスーパーコンピュータ「富岳」を用いて訓練した日本語能力に優れた大規模言語モデル「Fugaku-LLM」を公開した。研究者は、オープンソースソフトの公開に使われているプラットフォームである「ギットハブ(GitHub)」や「ハギングフェイズ(Hugging Face)」を通じて、研究および商業目的で利用できる。